Einsatz von Ultralytics YOLO11 auf Rockchip für effiziente Edge-KI

Erfahren Sie, wie Sie Ultralytics YOLO11 auf Rockchip mit dem RKNN Toolkit für effiziente Edge AI, AI-Beschleunigung und Echtzeit-Objekterkennung einsetzen können.

Erfahren Sie, wie Sie Ultralytics YOLO11 auf Rockchip mit dem RKNN Toolkit für effiziente Edge AI, AI-Beschleunigung und Echtzeit-Objekterkennung einsetzen können.

Ein aktuelles Schlagwort in der KI-Community ist Edge AI, insbesondere wenn es um Computer Vision geht. Mit dem Wachstum KI-gesteuerter Anwendungen steigt der Bedarf, Modelle effizient auf eingebetteten Geräten mit begrenzter Leistung und Rechenressourcen auszuführen.

Drohnen nutzen beispielsweise Vision AI für die Echtzeitnavigation, intelligente Kameras detect Objekte sofort, und industrielle Automatisierungssysteme führen Qualitätskontrollen durch, ohne auf Cloud-Computing angewiesen zu sein. Diese Anwendungen erfordern eine schnelle, effiziente KI-Verarbeitung direkt auf Edge-Geräten, um Echtzeitleistung und geringe Latenzzeiten zu gewährleisten. Die Ausführung von KI-Modellen auf Edge-Geräten ist jedoch nicht immer einfach. KI-Modelle benötigen oft mehr Leistung und Speicher, als viele Edge-Geräte bewältigen können.

Das RKNN Toolkit von Rockchip hilft bei der Lösung dieses Problems, indem es Deep-Learning-Modelle für Rockchip-betriebene Geräte optimiert. Es verwendet dedizierte Neural Processing Units (NPUs), um die Inferenz zu beschleunigen und die Latenzzeit und den Stromverbrauch im Vergleich zur CPU oder GPU zu reduzieren.

Die Vision AI-Gemeinschaft hat eifrig an der Durchführung von Ultralytics YOLO11 auf Rockchip-basierten Geräten auszuführen, und wir haben Sie gehört. Wir haben Unterstützung für den Export von YOLO11 in das RKNN-Modellformat hinzugefügt. In diesem Artikel erfahren Sie, wie der Export in das RKNN-Format funktioniert und warum der Einsatz von YOLO11 auf Rockchip-basierten Geräten eine entscheidende Neuerung darstellt.

Rockchip ist ein Unternehmen, das System-on-Chips (SoCs) entwickelt - winzige, aber leistungsstarke Prozessoren, die viele eingebettete Geräte betreiben. Diese Chips kombinieren eine CPU, eine GPU und eine Neural Processing Unit (NPU), um alles von allgemeinen Rechenaufgaben bis hin zu Vision AI-Anwendungen zu bewältigen, die auf Objekterkennung und Bildverarbeitung angewiesen sind.

Rockchip SoCs werden in einer Vielzahl von Geräten eingesetzt, darunter Single-Board-Computer (SBCs), Entwicklungsboards, industrielle KI-Systeme und intelligente Kameras. Viele bekannte Hardwarehersteller, Radxa, ASUS, Pine64, Orange Pi, Odroid, Khadas und Banana Pi, bauen Geräte, die mit Rockchip SoCs betrieben werden. Diese Boards sind beliebt für Edge-KI und Computer-Vision-Anwendungen, da sie ein ausgewogenes Verhältnis von Leistung, Energieeffizienz und Erschwinglichkeit bieten.

Damit KI-Modelle auf diesen Geräten effizient laufen können, bietet Rockchip das RKNN (Rockchip Neural Network) Toolkit an. Es ermöglicht Entwicklern, Deep-Learning-Modelle zu konvertieren und zu optimieren, um die Neural Processing Units (NPUs) von Rockchip zu nutzen.

RKNN-Modelle sind für Inferenz mit niedriger Latenz und effizienten Stromverbrauch optimiert. Durch die Konvertierung von Modellen in RKNN können Entwickler schnellere Verarbeitungsgeschwindigkeiten, einen geringeren Stromverbrauch und eine verbesserte Effizienz auf Rockchip-basierten Geräten erzielen.

Werfen wir einen genaueren Blick darauf, wie RKNN-Modelle die KI-Leistung auf Rockchip-fähigen Geräten verbessern.

Im Gegensatz zu CPUs und GPUs, die ein breites Spektrum an Rechenaufgaben bewältigen, sind die NPUs von Rockchip speziell für Deep Learning konzipiert. Durch die Konvertierung von KI-Modellen in das RKNN-Format können Entwickler Inferenz direkt auf der NPU ausführen. Dies macht RKNN-Modelle besonders nützlich für Computer Vision Aufgaben in Echtzeit, bei denen eine schnelle und effiziente Verarbeitung unerlässlich ist.

NPUs sind schneller und effizienter als CPUs und GPUs für KI-Aufgaben, da sie für die parallele Verarbeitung von neuronalen Netzwerken entwickelt wurden. Während CPUs Aufgaben Schritt für Schritt verarbeiten und GPUs die Arbeitslast auf mehrere Kerne verteilen, sind NPUs für die effizientere Durchführung von KI-spezifischen Berechnungen optimiert.

Dadurch laufen RKNN-Modelle schneller und verbrauchen weniger Strom, wodurch sie sich ideal für batteriebetriebene Geräte, intelligente Kameras, industrielle Automatisierung und andere Edge-KI-Anwendungen eignen, die Entscheidungen in Echtzeit erfordern.

Die YOLO (You Only Look Once)Ultralytics sind für Echtzeit-Computer-Vision-Aufgaben wie Objekterkennung, Instanzsegmentierung und Bildklassifizierung konzipiert. Sie sind für ihre Schnelligkeit, Genauigkeit und Effizienz bekannt und werden in vielen Branchen eingesetzt, z. B. in der Landwirtschaft, der Fertigung, dem Gesundheitswesen und bei autonomen Systemen.

Diese Modelle haben sich im Laufe der Zeit erheblich verbessert. Zum Beispiel, Ultralytics YOLOv5 die Objekterkennung mit PyTorch erleichtert. Dann, Ultralytics YOLOv8 neue Funktionen wie Posenschätzung und Bildklassifizierung hinzu. Jetzt geht YOLO11 einen Schritt weiter, indem es die Genauigkeit erhöht und gleichzeitig weniger Ressourcen benötigt. Tatsächlich erzielt YOLO11m eine bessere Leistung auf dem COCO und verwendet dabei 22 % weniger Parameter als YOLOv8m, was es sowohl präziser als auch effizienter macht.

Ultralytics YOLO unterstützen auch den Export in mehrere Formate, was eine flexible Bereitstellung auf verschiedenen Plattformen ermöglicht. Zu diesen Formaten gehören ONNX, TensorRT, CoreML und OpenVINO, was den Entwicklern die Freiheit gibt, die Leistung auf der Grundlage ihrer Zielhardware zu optimieren.

Mit der zusätzlichen Unterstützung für den Export von YOLO11 in das RKNN-Modellformat kann YOLO11 nun die Vorteile der NPUs von Rockchip nutzen. Das kleinste Modell, YOLO11n im RKNN-Format, erreicht eine beeindruckende Inferenzzeit von 99,5 ms pro Bild und ermöglicht so eine Echtzeitverarbeitung auch auf eingebetteten Geräten.

Derzeit können YOLO11 in das RKNN-Format exportiert werden. Bleiben Sie dran - wir arbeiten daran, in zukünftigen Updates Unterstützung für andere Computer Vision Aufgaben und INT8-Quantisierung hinzuzufügen.

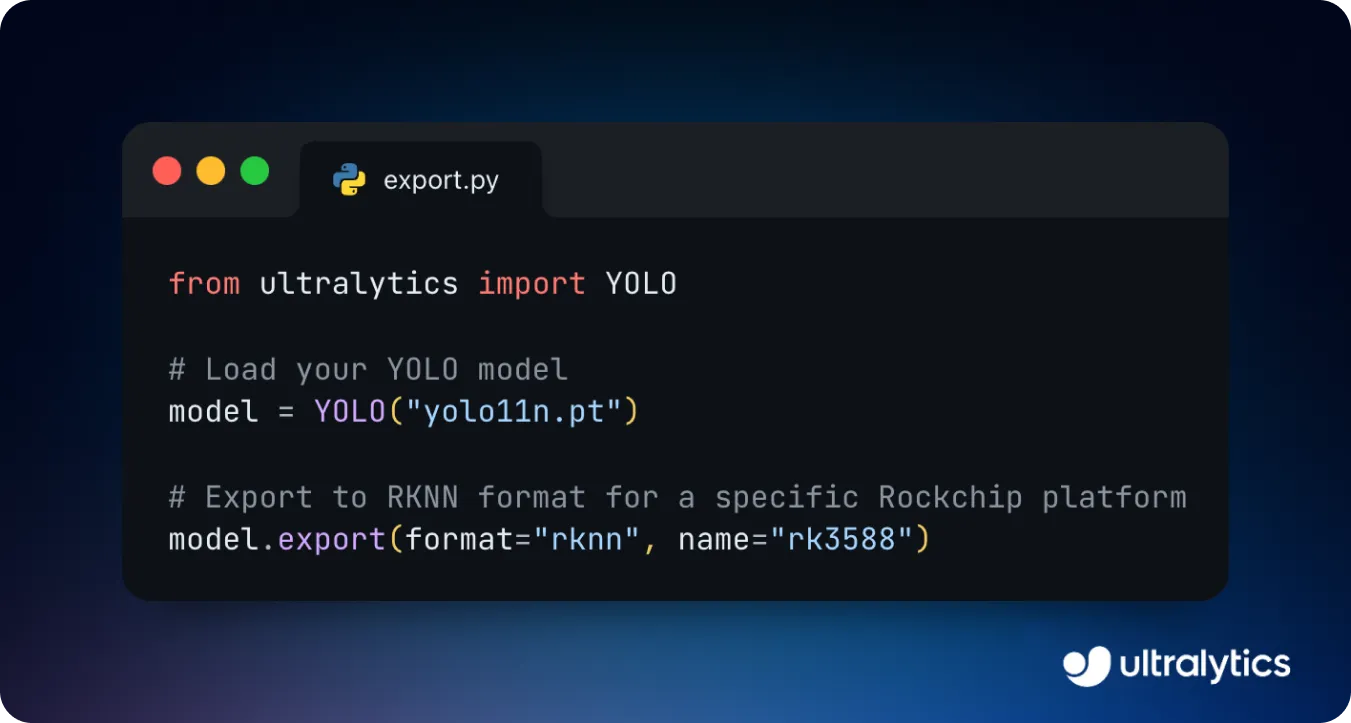

Der Export von YOLO11 in das RKNN-Format ist ein unkomplizierter Prozess. Sie können Ihr individuell trainiertes YOLO11 laden, die Rockchip-Zielplattform angeben und es mit ein paar Zeilen Code in das RKNN-Format konvertieren. Das RKNN-Format ist mit verschiedenen Rockchip-SoCs kompatibel, darunter RK3588, RK3566 und RK3576, wodurch eine breite Hardware-Unterstützung gewährleistet ist.

Sobald das RKNN-Modell exportiert wurde, kann es auf Rockchip-basierten Geräten eingesetzt werden. Um das Modell einzusetzen, laden Sie einfach die exportierte RKNN-Datei auf Ihr Rockchip-Gerät und starten die Inferenz - den Prozess der Verwendung des trainierten KI-Modells, um neue Bilder oder Videos zu analysieren und Objekte in Echtzeit detect . Mit nur wenigen Zeilen Code können Sie beginnen, Objekte aus Bildern oder Videostreams zu identifizieren.

Um eine bessere Vorstellung davon zu bekommen, wo YOLO11 auf Rockchip-fähigen Geräten in der realen Welt eingesetzt werden kann, lassen Sie uns einige wichtige Edge-KI-Anwendungen durchgehen.

Rockchip Prozessoren werden häufig in Android Tablets, Entwicklungsboards und industriellen KI-Systemen eingesetzt. Dank der Unterstützung für Android, Linux und Python können Sie problemlos Vision-KI-gesteuerte Lösungen für eine Vielzahl von Branchen entwickeln und einsetzen.

Eine häufige Anwendung, bei der YOLO11 auf Rockchip-betriebenen Geräten läuft, sind robuste Tablets. Dabei handelt es sich um robuste, leistungsstarke Tablets, die für raue Umgebungen wie Lagerhallen, Baustellen und industrielle Umgebungen entwickelt wurden. Diese Tablets können die Objekterkennung nutzen, um die Effizienz und Sicherheit zu verbessern.

In der Lagerlogistik zum Beispiel können Arbeiter ein Rockchip-betriebenes Tablet mit YOLO11 verwenden, um Inventar automatisch zu scannen und detect , wodurch menschliche Fehler reduziert und die Bearbeitungszeiten beschleunigt werden. In ähnlicher Weise können diese Tablets auf Baustellen eingesetzt werden, um detect , ob die Arbeiter die vorgeschriebene Sicherheitsausrüstung wie Helme und Westen tragen, was den Unternehmen hilft, Vorschriften durchzusetzen und Unfälle zu vermeiden.

In Bezug auf Fertigung und Automatisierung können Rockchip-basierte Industrieplatinen eine große Rolle bei der Qualitätskontrolle und Prozessüberwachung spielen. Eine Industrieplatine ist ein kompaktes, leistungsstarkes Rechenmodul, das für eingebettete Systeme in industriellen Umgebungen entwickelt wurde. Diese Platinen umfassen typischerweise Prozessoren, Speicher, E/A-Schnittstellen und Konnektivitätsoptionen, die in Sensoren, Kameras und automatisierte Maschinen integriert werden können.

Die Ausführung von YOLO11 auf diesen Boards ermöglicht die Analyse von Produktionslinien in Echtzeit, um Probleme sofort zu erkennen und die Effizienz zu verbessern. In der Automobilproduktion beispielsweise kann ein KI-System mit Rockchip-Hardware und YOLO11 Kratzer, falsch ausgerichtete Teile oder Lackfehler detect , während die Autos das Fließband durchlaufen. Indem diese Mängel in Echtzeit erkannt werden, können die Hersteller den Ausschuss reduzieren, die Produktionskosten senken und höhere Qualitätsstandards gewährleisten, bevor die Fahrzeuge die Kunden erreichen.

Rockchip-basierte Geräte bieten ein gutes Gleichgewicht zwischen Leistung, Kosten und Effizienz, was sie zu einer guten Wahl für den Einsatz von YOLO11 in Edge-KI-Anwendungen macht.

Hier sind einige Vorteile der Ausführung von YOLO11 auf Rockchip-basierten Geräten:

Ultralytics YOLO11 kann effizient auf Rockchip-basierten Geräten ausgeführt werden, indem es Hardware-Beschleunigung und das RKNN-Format nutzt. Dies verkürzt die Inferenzzeit und verbessert die Leistung, wodurch es sich ideal für Echtzeit-Computer-Vision-Aufgaben und Edge-KI-Anwendungen eignet.

Das RKNN-Toolkit bietet wichtige Optimierungswerkzeuge wie Quantisierung und Feinabstimmung, die sicherstellen, dass YOLO11 auf Rockchip-Plattformen gut funktionieren. Die Optimierung von Modellen für eine effiziente Verarbeitung auf dem Gerät wird mit der zunehmenden Verbreitung von Edge AI von entscheidender Bedeutung sein. Mit den richtigen Tools und der richtigen Hardware können Entwickler neue Möglichkeiten für Computer-Vision-Lösungen in verschiedenen Branchen erschließen.

Treten Sie unserer Community bei und erkunden Sie unser GitHub-Repository, um mehr über KI zu erfahren. Sehen Sie sich auf unseren Lösungsseiten an, wie Computer Vision in der Landwirtschaft und KI im Gesundheitswesen Innovationen vorantreiben. Sehen Sie sich auch unsere Lizenzoptionen an, um noch heute mit der Entwicklung Ihrer Vision AI-Lösungen zu beginnen!