強いAIと汎用人工知能(AGI)が弱いAIとどのように異なるかを学びましょう。その潜在的な応用、課題、将来の可能性を探ります。

強いAIと汎用人工知能(AGI)が弱いAIとどのように異なるかを学びましょう。その潜在的な応用、課題、将来の可能性を探ります。

人工知能(AI)は、チェスのチャンピオンを打ち負かしたり、交響曲を作曲したり、病気を検出したりするなど、さまざまなアプリケーションに使用できます。現実世界の環境と相互作用しているにもかかわらず、AIモデルは世界を真に理解しているわけではありません。それらはアイデアではなく、パターンに従って分析します。

今日の既存のAIモデルのほとんどは、狭いAIまたは弱いAIに分類されます。これは、画像認識や音声処理などの特定のタスクには最適ですが、人間の知能のような柔軟性がありません。

これらの制限を克服するために、研究者は強いAI、つまり汎用人工知能(AGI)の中核要素に積極的に取り組んでいます。これは、人間のような認知能力を持ち、幅広い知的タスクを実行するように設計されたシステムを指します。

強いAIはまだ理論的ですが、この分野での継続的な研究のおかげで、AGIセクターの市場価値は、2023年の30億1000万ドルから2032年までに520億ドルに成長すると予想されています。これらの数字は、強いAI主導のイノベーションの可能性を示しています。

この記事では、強いAIとは何か、既存のAIモデルとどのように異なるのか、そしてその潜在的な応用について探求します。

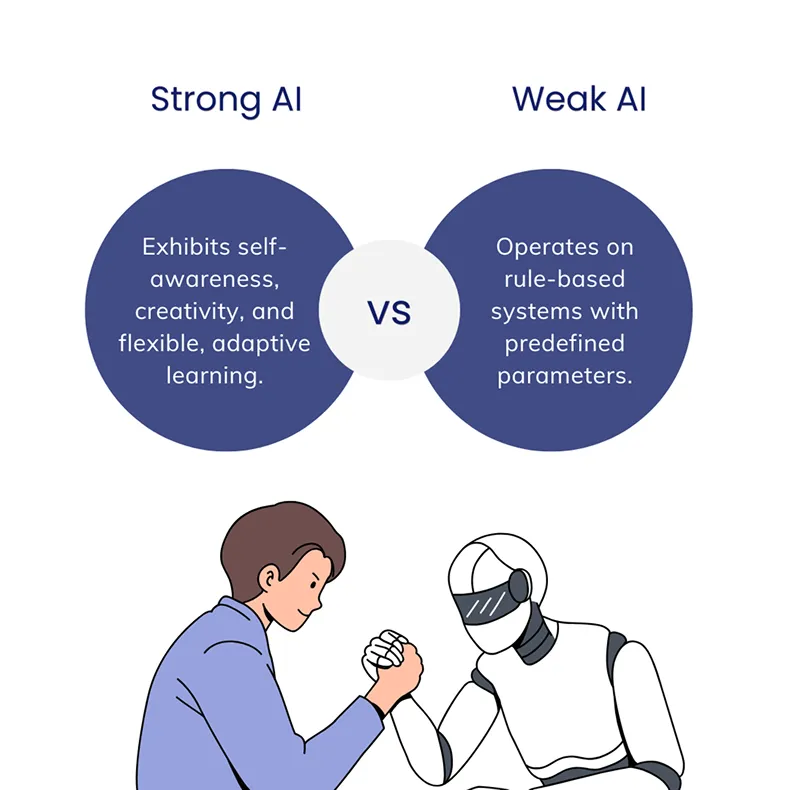

強いAIとは、人間ができるあらゆる知的タスクを実行できるAIシステムを指します。理想的には、定義済みの指示に頼ることなく、さまざまな分野にわたって推論、学習、知識の応用が可能です。特定のタスクに特化した弱いAIとは異なり、強いAIは汎用的な知能を備えており、情報を分析し、独立した意思決定を行い、新しい状況に適応できます。

この概念は、汎用人工知能(AGI)のサブセットです。AGIは、事実上あらゆるタスクを処理できる人間のような知能を持つ機械を指しますが、強いAIは、推論、理解、および自律的な意思決定を重視します。

強力なAIとは何かを知るために、自律走行車のコンピューター・ビジョン・モデルがどのように機能するかを考えてみよう。今日のモデルは歩行者をdetect classify することはできるが、ほとんどのモデルは、その人が横断しようとしているのか、ためらっているのか、助けを求めるサインを送っているのか、といったコンテクストを理解していない。対照的に、強力なAIシステムは歩行者の身振り手振り、道路状況、周囲の交通状況を分析し、人間のドライバーのような判断を下すだろう。

AIがこのような高度な応用に向かうにつれ、「強いAI」はいつ実現するのかという議論が浮上している。Anthropic社のCEOであるDario Amodei氏は、超知的なAIがごく近いうちに登場する可能性があると予測し、次のように述べている。"いつ登場するかは正確にはわからないが、AIシステムがほとんどすべてにおいて人間より優れているようになるのは、2027年よりもずっと先のことではないと思う。"

強いAIと弱いAIを比較して、これらの概念をより詳細に理解しましょう。概要は次のとおりです。

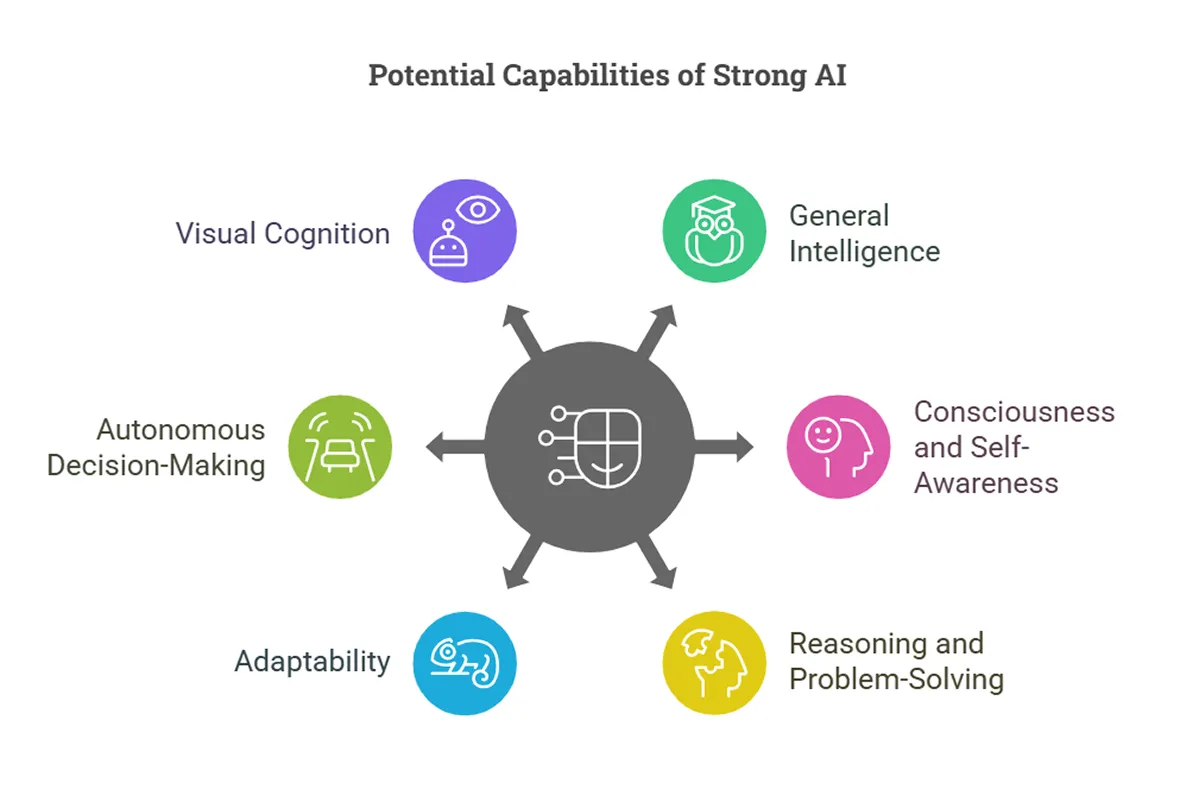

研究者が強いAIに近づくために取り組む中で、現在のシステムとは一線を画すいくつかの重要な特徴を特定しました。それらの特徴を以下に示します。

強いAIは、いつの日かさまざまな産業における人工知能の応用方法を変える可能性があり、現在進行中の研究がその可能性への道を切り開いています。このテクノロジーがさまざまな分野をどのように変革するかを探ってみましょう。

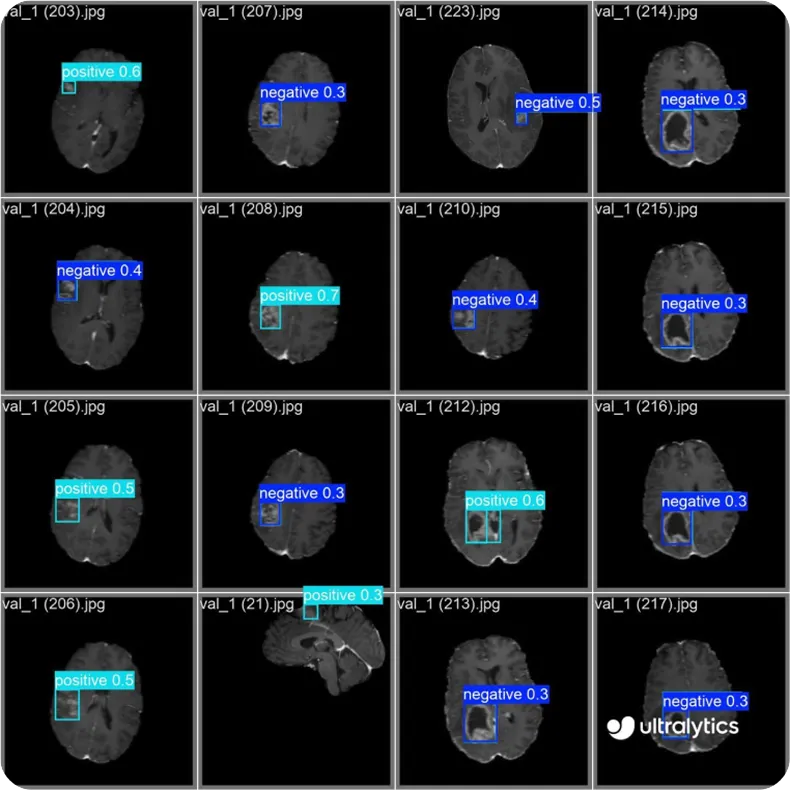

AIはすでに、診断、治療、ロボット手術など、ヘルスケア産業における多くの作業を強化している。例えば Ultralytics YOLO11のようなコンピュータ・ビジョン・モデルは、医療スキャンにおける異常のdetect 使用されている。このアプリケーションは効率を向上させるだけでなく、重要な作業におけるヒューマンエラーの可能性を減らすのにも役立つ。

将来的には、強いAIは、医療画像をより人間のように解釈することで、これらのアプリケーションを向上させる可能性があります。患者の病歴、症状、リスク要因などの要素を考慮して、複雑な診断を支援し、個別の治療法を推奨します。

また、強いAIシステムは、ウェアラブルデバイスや電子カルテからのリアルタイムデータを統合し、患者の状態をより包括的に把握できます。この統合により、潜在的な健康問題の早期発見につながり、より積極的で個別化された治療計画が可能になります。

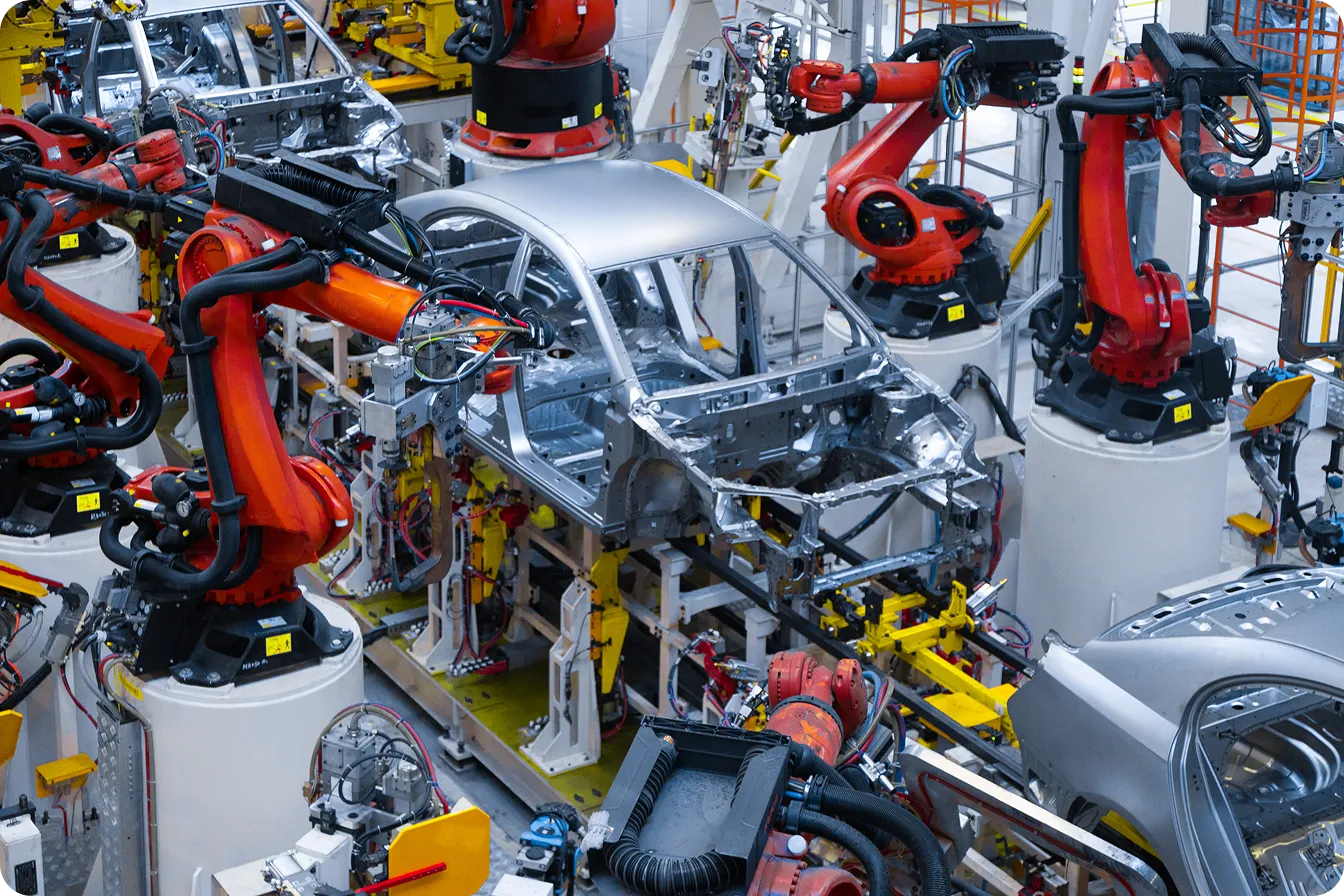

製造プロセスは、強いAIの統合により、より効率的になる可能性があります。今日、製造業におけるAIロボットは、視覚検査や品質管理などのタスクに弱いAIを利用しています。

しかし、強いAIを使用すると、これらのシステムは単にパターンを認識する以上のことができます。生産プロセス全体を理解し、変化に適応し、自律的な意思決定を行うことができます。これは、ワークフローの調整、リアルタイムでの問題への対処、品質管理からサプライチェーン管理までのすべてを最適化できることを意味します。これらはすべて、人間の介入なしで行われます。

物理学、生物学、工学におけるAI主導の発見は、複雑なデータセットのパターンを特定し、仮説検証を自動化することで、イノベーションを加速させる可能性がある。例えば、Google 物理的環境をシミュレートする「ワールドモデル」を開発している。これらのモデルはロボットを訓練し、AIがダイナミックな環境と相互作用する能力を向上させるのに役立ち、科学シミュレーション、ゲーム、映画制作などに応用されている。

これらの進歩は、AGIを開発するというGoogle広範な目標の一部である。ディープマインドのデミス・ハサビスCEOは、2030年までにAGIを実現すれば、AIは人類にとって最も有益な技術のひとつになると考えている。

強いAIは、産業と意思決定を再構築する可能性を秘めていますが、責任を持って管理する必要のある技術的、倫理的、およびセキュリティ上の重大なリスクも伴います。

CIGIのGlobal AI RisksイニシアチブのエグゼクティブディレクターであるDuncan Cass-Beggs氏は、ポッドキャストで次のように述べています。「私たちはすべてのリスクを回避しようとしているわけではないと思います。結局のところ、すべてのテクノロジーは利益とリスクをもたらします...たとえば、自動車では、常にリスクを軽減しようとしていますが、自動車は害を及ぼすにもかかわらず、自動車がもたらす利益のために、ある程度の害を受け入れる用意があります。」

彼の見解は、強いAIの約束は大きいものの、その潜在的な欠点についても現実的である必要があることを示唆しています。イノベーションと慎重さのバランスを取るスマートなポリシーの必要性を強調しています。業界、政府、国際的な境界を越えて協力することで、強いAIの利点を活用しながら、そのリスクを制御できる、実用的な戦略と堅牢なガバナンスフレームワークを開発できます。

人工汎用知能(AGI)の分野では、エキサイティングな可能性を示すブレークスルーが徐々に現れています。たとえば、OpenAIの最新モデルであるo3は、ARC-AGIベンチマークで85%のスコアを達成しました。ARCはAbstraction and Reasoning Corpusの略で、システムが抽象的な概念を学習し、人間のように新しい問題を解決する能力を測定するテストです。このモデルはまだ強いAIとは見なされていませんが、情報を処理し、適応し、新しい方法で知識を使用できるシステムへの進歩を示しています。

強いAIは、複数のドメインにわたって汎用的な知能、推論、適応性を実現することにより、現在のAIシステムを上回る可能性があります。ただし、AIの権利、意思決定の責任、監視または自律システムでの誤用のリスクなど、倫理的およびセキュリティ上の課題は依然として重要な懸念事項です。強いAIはまだ理論的ですが、現在進行中の研究は、AIをより高い知性と自律性に向けて推進し続けています。

成長を続けるコミュニティに参加しましょう!GitHubリポジトリを調べて、AIについてさらに深く掘り下げてください。コンピュータビジョンを組織のワークフローに統合することに関心がある場合は、ライセンスオプションをご覧ください。医療におけるコンピュータビジョンがどのように効率を向上させているか、およびソリューションページにアクセスして製造業におけるAIの影響について調べてください。