Мультимодальная модель

Узнайте, как мультимодальные модели интегрируют текст, изображения и аудио. Познакомьтесь с такими архитектурами, как Ultralytics , и внедрите искусственный интеллект для обработки изображений на Ultralytics .

Мультимодальная модель — это усовершенствованный тип

системы искусственного интеллекта (ИИ),

способный одновременно обрабатывать, интерпретировать и интегрировать информацию из нескольких различных типов данных, или

«модальностей». В то время как традиционные одномодальные системы специализируются на одной области, такой как

обработка естественного языка (NLP)

для текста или компьютерное зрение (CV) для

изображений, мультимодальные модели стремятся имитировать человеческое восприятие, синтезируя визуальные, аудио и лингвистические сигналы

вместе. Такая конвергенция позволяет модели развивать всестороннее понимание мира, что дает ей возможность устанавливать

сложные корреляции между визуальной сценой и устным описанием. Эти возможности считаются основополагающими

шагами на пути к достижению

искусственного общего интеллекта (AGI).

Основные механизмы и архитектура

Эффективность мультимодальной модели зависит от ее способности сопоставлять различные типы данных в общем семантическом пространстве. Этот

процесс обычно начинается с создания

вложений, которые представляют собой числовые представления,

отражающие основной смысл входных данных. Благодаря обучению на огромных наборах данных парных примеров, таких как видео

с субтитрами, модель учится соотносить векторное представление изображения «кошки» с текстовым вложением

для слова «кошка».

Несколько ключевых архитектурных концепций делают эту интеграцию возможной:

-

Архитектура трансформера: Многие

мультимодальные системы используют трансформеры, которые применяют

механизмы внимания для динамической оценки

важности различных частей ввода. Это позволяет модели сосредоточиться на определенных областях изображения, которые соответствуют

релевантным словам в текстовом запросе, концепция, подробно описанная в основополагающей научной статье

«Внимание — это все, что вам нужно».

-

Слияние данных: это стратегия объединения информации из разных источников.

Слияние датчиков может происходить на раннем этапе путем объединения необработанных данных или на позднем этапе

путем объединения решений отдельных подмоделей. Современные фреймворки, такие как

PyTorch обеспечивают гибкость, необходимую для построения этих сложных конвейеров.

-

Контрастивное обучение: методы, используемые такими моделями, как

CLIP от OpenAI, обучают систему минимизировать расстояние между

соответствующими парами «текст-изображение» в векторном пространстве, одновременно максимизируя расстояние между несоответствующими парами.

Применение в реальном мире

Мультимодальные модели открыли возможности, которые ранее были недостижимы для одномодальных систем.

-

Визуальный ответ на вопрос (VQA):

Эти системы позволяют пользователям задавать вопросы о изображении на естественном языке. Например, пользователь с нарушениями зрения

может загрузить фотографию кладовой и спросить: «Есть ли банка супа на верхней полке?» Модель использует

обнаружение объектов для идентификации предметов и NLP для

понимания запроса, предоставляя полезный ответ.

-

Автономные транспортные средства:

Автомобили с автономным управлением функционируют как мультимодальные агенты, работающие в режиме реального времени. Они объединяют визуальные данные с камер, информацию о глубине

от LiDAR и данные о скорости от радара. Такая избыточность гарантирует, что если один датчик будет заблокирован

погодными условиями, другие смогут обеспечить

безопасность на дороге.

-

Обнаружение с открытым словарем: модели, такие как

Ultralytics YOLO, позволяют пользователям detect объекты

с помощью произвольных текстовых подсказок, а не фиксированного списка классов. Это устраняет разрыв между лингвистическими командами

и визуальным распознаванием.

Пример: обнаружение открытого словаря

Следующий пример демонстрирует, как использовать ultralytics библиотеку для выполнения обнаружения с открытым словарем,

где модель интерпретирует текстовые подсказки для идентификации объектов на изображении:

from ultralytics import YOLOWorld

# Load a pre-trained YOLO-World model capable of vision-language understanding

model = YOLOWorld("yolov8s-world.pt")

# Define custom classes using natural language text prompts

model.set_classes(["person wearing a hat", "blue backpack"])

# Run inference: The model aligns text prompts with visual features

results = model.predict("https://ultralytics.com/images/bus.jpg")

# Visualize the detection results

results[0].show()

Отличия от родственных терминов

Полезно отличать «мультимодальную модель» от смежных понятий в глоссарии ИИ:

-

Мультимодальное обучение: это

относится к процессу и

методам машинного обучения (ML), используемым для

обучения этих систем. Мультимодальная модель является конечным результатом или программным продуктом этого процесса обучения.

-

Крупные языковые модели (LLM):

Традиционные LLM обрабатывают только текст. Хотя многие из них эволюционируют в модели «зрение-язык» (VLM), стандартная LLM является

унимодальной.

-

Базовые модели: это

более широкая категория, описывающая крупномасштабные модели, адаптируемые к многим последующим задачам. Хотя мультимодальная модель

часто является базовой моделью, не все базовые модели обрабатывают несколько модальностей.

Будущее мультимодального искусственного интеллекта

Эта область быстро развивается в направлении систем, способных обрабатывать непрерывные потоки аудио, видео и текста в

реальном времени. Исследования таких организаций, как Google , продолжают расширять

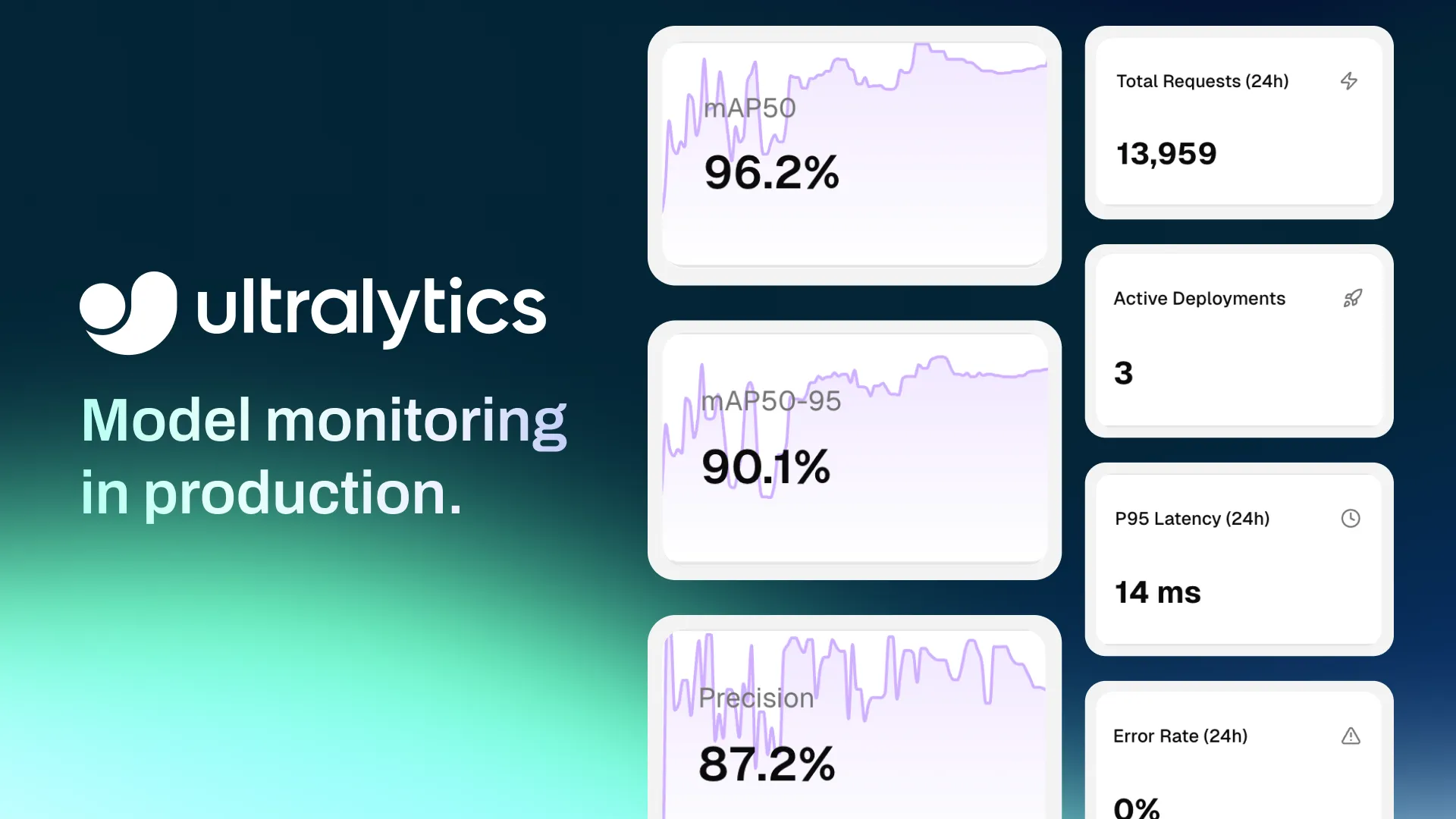

границы машинного восприятия. В Ultralytics мы поддерживаем эту экосистему с помощью высокопроизводительных базовых систем видения,

таких как YOLO26. Выпущенная в 2026 году, YOLO26 предлагает превосходную скорость

и точность для таких задач, как

сегментация экземпляров, служа

эффективным визуальным компонентом в более крупных мультимодальных конвейерах. Разработчики могут управлять данными, обучением и развертыванием

этих сложных рабочих процессов с помощью унифицированной Ultralytics .