Apple a annoncé de nouvelles fonctionnalités d’accessibilité basées sur l’IA, telles que le suivi oculaire, le retour haptique musical et les raccourcis vocaux, qui offrent des expériences utilisateur fluides.

Apple a annoncé de nouvelles fonctionnalités d’accessibilité basées sur l’IA, telles que le suivi oculaire, le retour haptique musical et les raccourcis vocaux, qui offrent des expériences utilisateur fluides.

Le 15 mai 2024, Apple a annoncé une série de mises à jour pour iOS 18, en mettant l'accent sur l'accessibilité. Prévues pour la fin de l'année, les nouvelles mises à jour d'Apple comprennent des fonctionnalités innovantes telles que le suivi des yeux, la musique haptique et les raccourcis vocaux.

Ces fonctionnalités d’accessibilité d’Apple facilitent l’utilisation des appareils Apple pour les personnes ayant des problèmes de mobilité, les personnes sourdes ou malvoyantes et les personnes ayant des difficultés d’élocution. Les puces Apple, l’intelligence artificielle (IA) et l’apprentissage automatique sont les avancées technologiques à l’origine de ces capacités. Explorons les nouvelles fonctionnalités d’Apple et l’impact qu’elles auront sur la vie quotidienne.

En tant que société, nous devons nous assurer que nos avancées technologiques sont inclusives pour tous. Rendre la technologie accessible peut changer la vie de nombreuses personnes. Par exemple, la technologie est un élément essentiel de tout emploi de nos jours, mais les interfaces inaccessibles peuvent créer des obstacles professionnels pour les personnes handicapées. Des études montrent que le taux de chômage des personnes handicapées est près du double de celui des personnes non handicapées en 2018.

Les systèmes juridiques abordent également la question de l’accessibilité de la technologie. De nombreux pays ont ajouté des lois imposant des normes d’accessibilité pour les sites Web et les produits numériques. Aux États-Unis, les poursuites liées à l’accessibilité des sites Web n’ont cessé d’augmenter, avec environ 14 000 poursuites liées à l’accessibilité Web intentées entre 2017 et 2022, dont plus de 3 000 rien qu’en 2022. Indépendamment des exigences légales, l’accessibilité est essentielle pour une société inclusive où chacun peut participer pleinement. C’est là qu’interviennent les fonctionnalités d’accessibilité Apple suivantes.

Apple s’efforce de rendre la technologie accessible à tous depuis 2009. Cette année-là, ils ont lancé VoiceOver, une fonctionnalité qui permettait aux utilisateurs aveugles et malvoyants de naviguer sur leurs iPhones à l’aide de gestes et de commentaires audibles. La lecture de ce qui se trouve à l’écran facilite l’interaction des utilisateurs avec leurs appareils.

Depuis lors, Apple n’a cessé d’améliorer et d’étendre ses fonctionnalités d’accessibilité. Ils ont introduit Zoom pour l’agrandissement de l’écran, Inverser les couleurs pour un meilleur contraste visuel et Mono Audio pour les personnes malentendantes. Ces fonctionnalités ont considérablement amélioré la façon dont les utilisateurs ayant divers handicaps interagissent avec leurs appareils.

Voici un aperçu de certaines des principales fonctionnalités d'accessibilité d'Apple que nous avons vues par le passé :

Une personne à mobilité réduite des mains peut désormais facilement naviguer sur Internet, envoyer des messages ou même contrôler des appareils domotiques intelligents en regardant simplement son écran. Ces avancées rendent leur vie quotidienne plus facile, leur permettant d'accomplir de manière indépendante des tâches qu'elles trouvaient auparavant difficiles.

Une autre fonctionnalité d'accessibilité Apple intéressante à venir est le suivi oculaire, qui en fait une réalité. Conçu pour les utilisateurs ayant un handicap physique, le suivi oculaire offre une option de navigation mains libres sur les iPads et les iPhones. En utilisant l'IA et la caméra frontale pour voir où vous regardez, il vous permet d'activer des boutons, des balayages et d'autres gestes sans effort.

La caméra frontale configure et calibre l'Eye Tracking en quelques secondes. Vous pouvez utiliser Dwell Control pour interagir avec les éléments de l'application, en accédant à des fonctions telles que les boutons et les balayages avec vos seuls yeux. Les utilisateurs peuvent être sûrs que leur vie privée est protégée car l'appareil traite toutes les données de manière sécurisée en utilisant l'apprentissage automatique de l'appareil. L'Eye Tracking fonctionne de manière transparente dans les applications iPadOS et iOS , sans nécessiter de matériel ou d'accessoires supplémentaires. Le système VisionOS d'Apple Vision Pro comprend également une fonction de suivi oculaire pour faciliter la navigation.

Music Haptics est une autre des fonctionnalités d'accessibilité Apple qui seront bientôt disponibles. Il a été conçu pour que les utilisateurs sourds ou malentendants puissent profiter de la musique sur leur iPhone. Lorsqu'il est utilisé, le Taptic Engine génère des tapotements, des textures et des vibrations raffinées qui se synchronisent avec l'audio. Vous pouvez ressentir le rythme et les nuances de la musique. C'est assez approfondi, grâce à la capacité du Taptic Engine à produire différentes intensités, motifs et durées de vibrations pour capturer la sensation de la musique.

Music Haptics peut connecter une personne malentendante à la musique d'une manière qui n'était pas possible auparavant. Cela ouvre un monde d'expériences dans sa vie quotidienne. Aller courir en écoutant de la musique ou apprécier une chanson avec un ami devient une expérience partagée et immersive. Les vibrations peuvent correspondre à l'énergie d'une liste de lecture d'entraînement, ce qui rend l'exercice plus motivant, ou aider à calmer les nerfs avec un air de méditation préféré. Music Haptics prend en charge des millions de chansons du catalogue Apple Music et sera disponible sous forme d'API pour les développeurs, leur permettant de créer des applications plus accessibles.

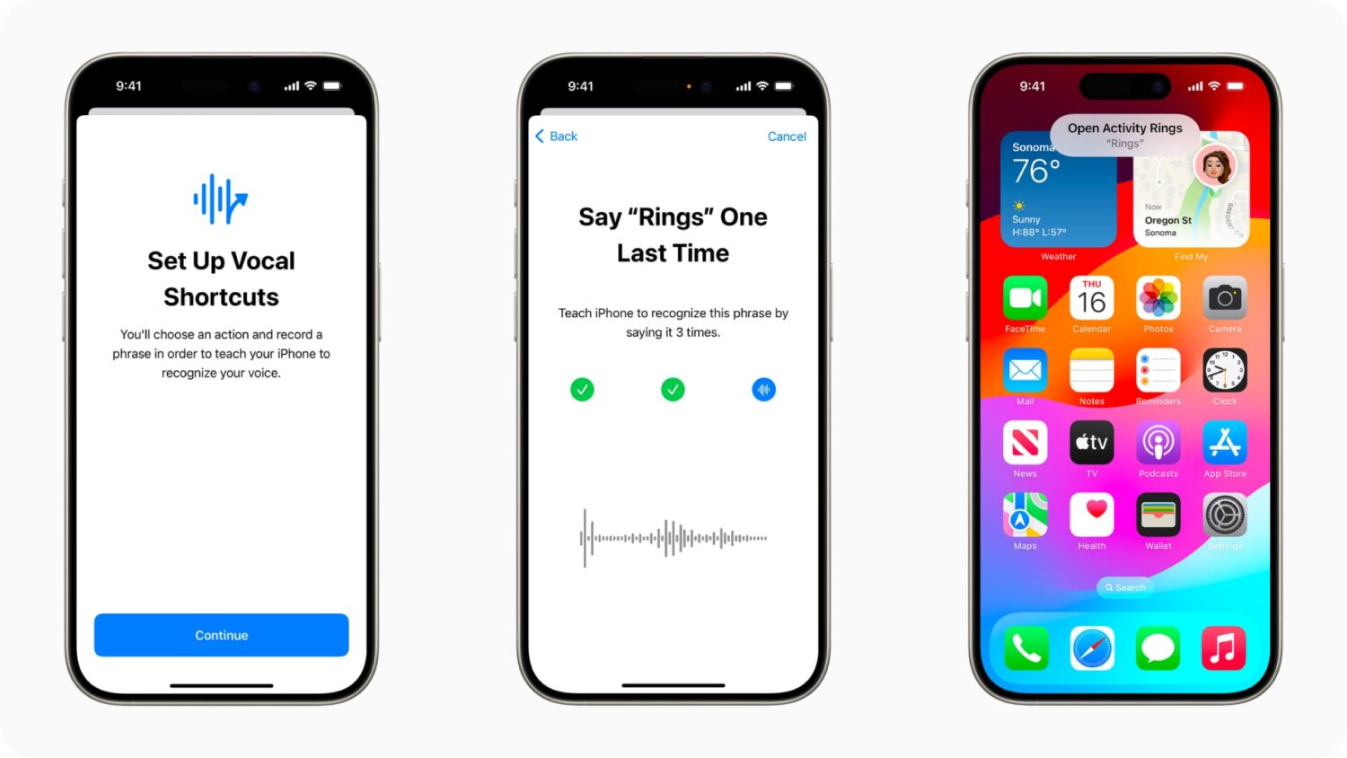

Apple a conçu les raccourcis vocaux pour améliorer les systèmes vocaux à l'aide de l'IA dans la liste des nouvelles fonctionnalités d'accessibilité. Il permet aux utilisateurs d'iPhone et d'iPad de créer des "énoncés personnalisés" afin que Siri puisse lancer des raccourcis et gérer des tâches complexes. Ceci est particulièrement utile pour les personnes atteintes de maladies telles que la paralysie cérébrale, la SLA ou un accident vasculaire cérébral.

La fonction "Écouter les paroles atypiques" utilise l'apprentissage automatique sur l'appareil pour reconnaître et s'adapter aux différents modèles de parole, ce qui facilite des tâches telles que l'envoi de messages ou la définition de rappels. En prenant en charge les vocabulaires personnalisés et les mots complexes, les raccourcis vocaux offrent une expérience utilisateur personnalisée et efficace.

Il existe également quelques nouvelles fonctionnalités d'accessibilité Apple pour aider les passagers à utiliser leurs appareils plus confortablement pendant le voyage. Par exemple, Vehicle Motion Cues est une nouvelle fonctionnalité pour iPhone et iPad qui aide à réduire le mal des transports pour les passagers dans les véhicules en mouvement.

Le mal des transports est souvent dû à un décalage sensoriel entre ce qu'une personne voit et ce qu'elle ressent, ce qui rend l'utilisation des appareils inconfortable lorsqu'ils sont en mouvement. Les indices de mouvement du véhicule remédient à ce problème en affichant des points animés sur les bords de l'écran pour représenter les changements de mouvement du véhicule. Cela réduit les conflits sensoriels sans perturber le contenu principal. Cette fonction utilise les capteurs intégrés aux iPhones et iPads pour detect si un utilisateur se trouve dans un véhicule en mouvement et s'adapter en conséquence.

CarPlay a également reçu des mises à jour pour améliorer l'accessibilité. Voice Control permet aux utilisateurs d'utiliser CarPlay et ses applications à l'aide de commandes vocales, tandis que Sound Recognition alerte les personnes sourdes ou malentendantes des klaxons et des sirènes. Pour les utilisateurs daltoniens, les filtres de couleur améliorent la convivialité visuelle de l'interface CarPlay. Ces améliorations contribuent à rendre tous les passagers plus confortables pendant un trajet en voiture.

Apple Vision Pro offre déjà des fonctions d'accessibilité Apple telles que les sous-titres, les sous-titres codés et les transcriptions pour aider les utilisateurs à suivre les fichiers audio et vidéo. Aujourd'hui, Apple étend encore ces fonctionnalités. La nouvelle fonction de sous-titrage en direct pilotée par l'IA permet à chacun de suivre les dialogues parlés dans les conversations en direct et les fichiers audio des applications en affichant le texte à l'écran en temps réel. Cette fonction est particulièrement utile pour les personnes sourdes ou malentendantes.

Par exemple, lors d'un appel FaceTime dans VisionOS, les utilisateurs peuvent voir le dialogue parlé transcrit à l'écran, ce qui facilite la connexion et la collaboration à l'aide de leur Persona (un avatar virtuel généré par ordinateur).

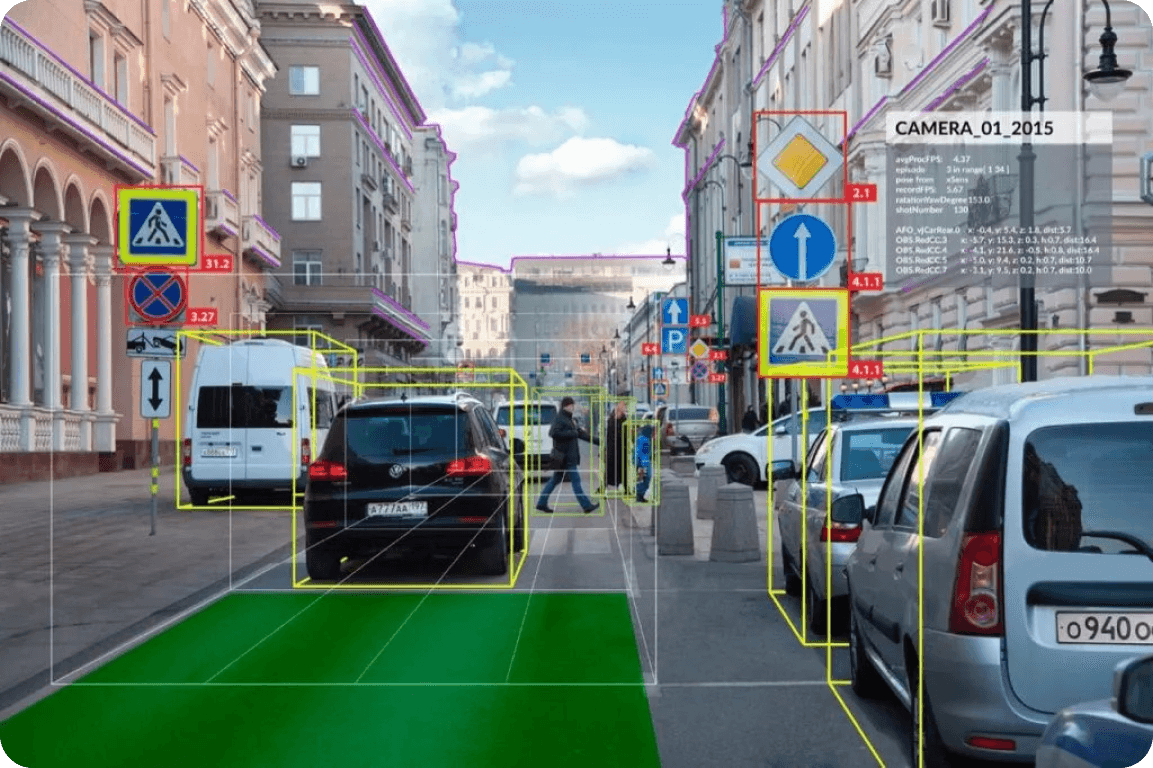

À l'instar des initiatives d'Apple en matière d'accessibilité, de nombreuses autres entreprises effectuent activement des recherches et innovent en utilisant l'IA pour créer des solutions accessibles. Par exemple, les véhicules autonomes basés sur l'IA peuvent offrir aux personnes à mobilité réduite une plus grande autonomie en facilitant la conduite. Jusqu'à présent, les personnes handicapées pouvaient conduire à l'aide de véhicules spécialement modifiés avec des adaptations telles que des commandes manuelles, des aides à la direction et des fonctions accessibles aux fauteuils roulants. Grâce à l'intégration de technologies d'IA telles que la vision par ordinateur, ces véhicules peuvent désormais offrir encore plus d'assistance.

Le système Autopilot de Tesla est un bon exemple d'aide à la conduite améliorée par l'IA. Il utilise des capteurs et des caméras avancés pour detect obstacles, interpréter les feux de circulation et fournir une aide à la navigation en temps réel. Grâce à ces apports de l'IA, le véhicule peut gérer diverses tâches de conduite, comme rester dans sa voie et ajuster sa vitesse en fonction des conditions de circulation. Les connaissances en matière de vision par ordinateur rendent la conduite plus sûre et plus accessible à tous.

Avec ces nouvelles mises à jour d'Apple, nous entrons dans une nouvelle ère d'inclusion basée sur l'IA. En intégrant l'IA dans ses fonctions d'accessibilité, Apple facilite les tâches quotidiennes des personnes handicapées et promeut l'inclusion et l'innovation dans la technologie. Ces avancées auront un impact sur divers marchés : les entreprises technologiques établiront de nouvelles références en matière d'inclusion, le secteur de la santé bénéficiera d'une plus grande autonomie pour les personnes handicapées, et l'électronique grand public connaîtra une demande accrue d'appareils accessibles. Il est probable que l'avenir de la technologie implique la création d'une expérience utilisateur transparente pour tous.

Consultez notre dépôt GitHub et rejoignez notre communauté pour rester informé des dernières avancées en matière d'IA. Découvrez comment l'IA remodèle la technologie de la conduite autonome, la fabrication, les soins de santé, et bien plus encore.