Intégrer la vision artificielle dans la robotique avec Ultralytics YOLO11

Découvrez comment les modèles de vision artificielle comme Ultralytics YOLO11 rendent les robots plus intelligents et façonnent l'avenir de la robotique.

Découvrez comment les modèles de vision artificielle comme Ultralytics YOLO11 rendent les robots plus intelligents et façonnent l'avenir de la robotique.

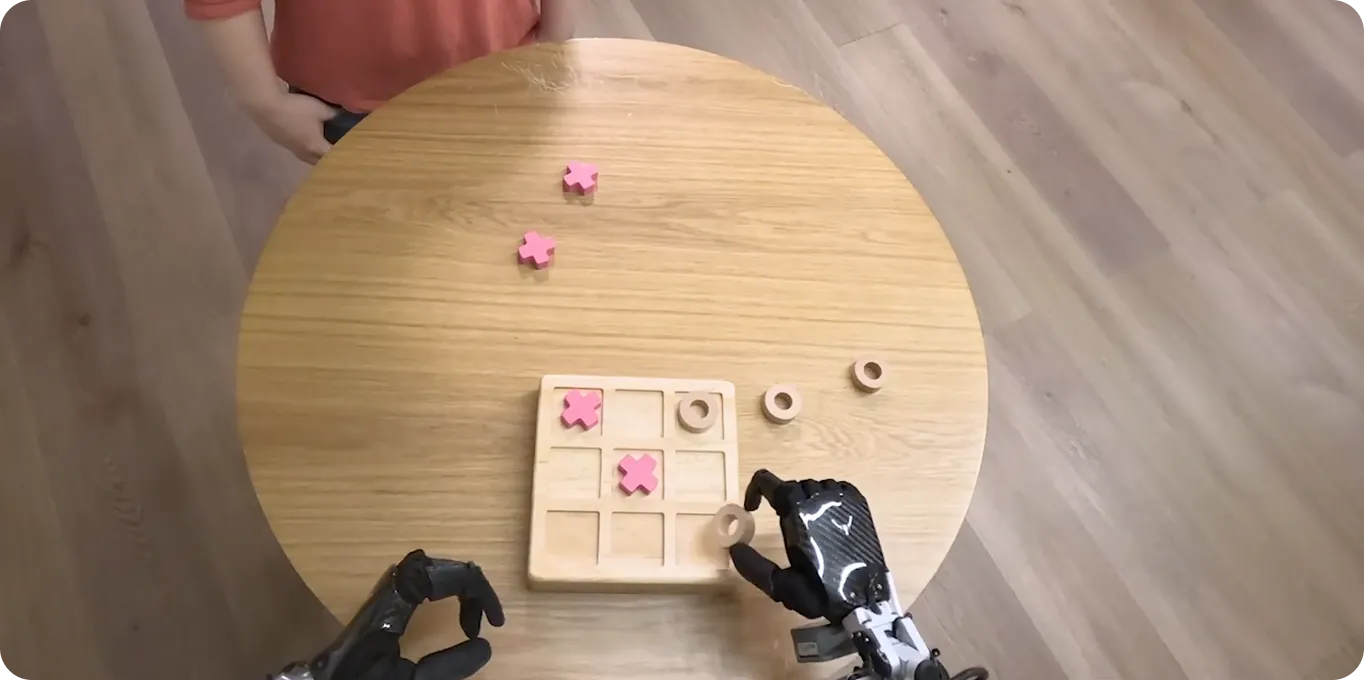

Les robots ont parcouru un long chemin depuis Unimate, le premier robot industriel, inventé dans les années 1950. Ce qui a commencé comme des machines préprogrammées et basées sur des règles est maintenant devenu des systèmes intelligents capables d'effectuer des tâches complexes et d'interagir de manière transparente avec le monde réel.

Aujourd'hui, les robots sont utilisés dans tous les secteurs, de la fabrication et des soins de santé à l'agriculture, pour diverses automatisations de processus. Un facteur clé de l'évolution de la robotique est l'IA et la vision par ordinateur, une branche de l'IA qui aide les machines à comprendre et à interpréter les informations visuelles.

Par exemple, des modèles de vision par ordinateur comme Ultralytics YOLO11 améliorent l'intelligence des systèmes robotiques. Intégrée dans ces systèmes, la vision artificielle permet aux robots de reconnaître des objets, de naviguer dans des environnements et de prendre des décisions en temps réel.

Dans cet article, nous verrons comment YOLO11 peut améliorer les robots grâce à des capacités avancées de vision par ordinateur et nous explorerons ses applications dans divers secteurs d'activité.

La fonctionnalité principale d'un robot dépend de sa capacité à comprendre son environnement. Cette conscience relie son matériel physique à une prise de décision intelligente. Sans elle, les robots ne peuvent que suivre des instructions fixes et ont du mal à s'adapter aux environnements changeants ou à gérer des tâches complexes. Tout comme les humains comptent sur la vue pour se déplacer, les robots utilisent la vision par ordinateur pour interpréter leur environnement, comprendre la situation et prendre les mesures appropriées.

En fait, la vision par ordinateur est fondamentale pour la plupart des tâches robotiques. Elle aide les robots à detect objets et à éviter les obstacles lorsqu'ils se déplacent. Toutefois, pour ce faire, il ne suffit pas de voir le monde ; les robots doivent également être capables de réagir rapidement. Dans des situations réelles, le moindre retard peut entraîner des erreurs coûteuses. Des modèles comme Ultralytics YOLO11 permettent aux robots de recueillir des informations en temps réel et de réagir instantanément, même dans des situations complexes ou inconnues.

Avant de voir comment YOLO11peut être intégré dans des systèmes robotiques, examinons d'abord ses principales caractéristiques.

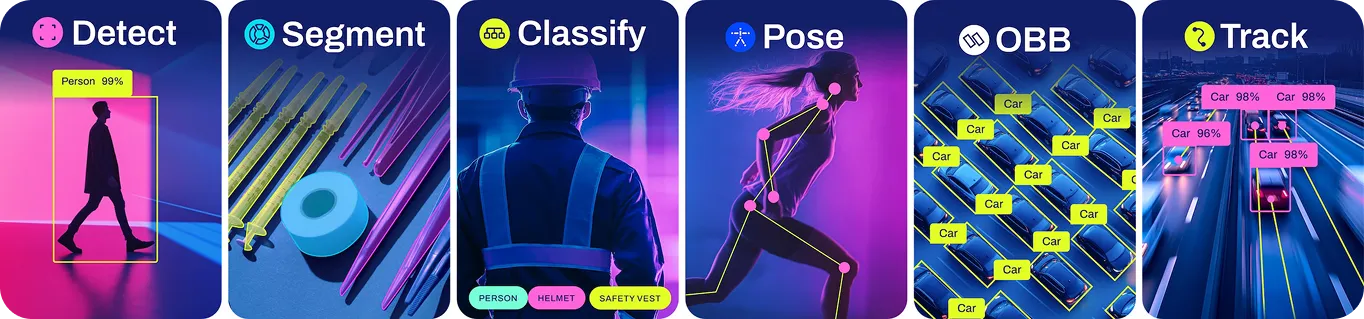

Les modèlesYOLO d'Ultralytics prennent en charge diverses tâches de vision par ordinateur qui permettent d'obtenir rapidement des informations en temps réel. En particulier, Ultralytics YOLO11 offre des performances plus rapides, des coûts de calcul plus faibles et une meilleure précision. Par exemple, il peut être utilisé pour detect objets dans des images et des vidéos avec une grande précision, ce qui le rend parfait pour des applications dans des domaines tels que la robotique, les soins de santé et la fabrication.

Voici quelques caractéristiques qui font de YOLO11 une excellente option pour la robotique :

Convivialité : la documentation et l'interface faciles à comprendre deYOLO11permettent de réduire la courbe d'apprentissage, ce qui facilite son intégration dans les systèmes robotiques.

Voici un aperçu de quelques-unes des tâches de vision par ordinateur prises en charge par YOLO11 :

De l'apprentissage intelligent à l'automatisation industrielle, des modèles comme YOLO11 peuvent contribuer à redéfinir les capacités des robots. Son intégration dans la robotique démontre que les modèles de vision par ordinateur sont à l'origine de progrès dans le domaine de l'automatisation. Examinons quelques domaines clés dans lesquels YOLO11 peut avoir un impact significatif.

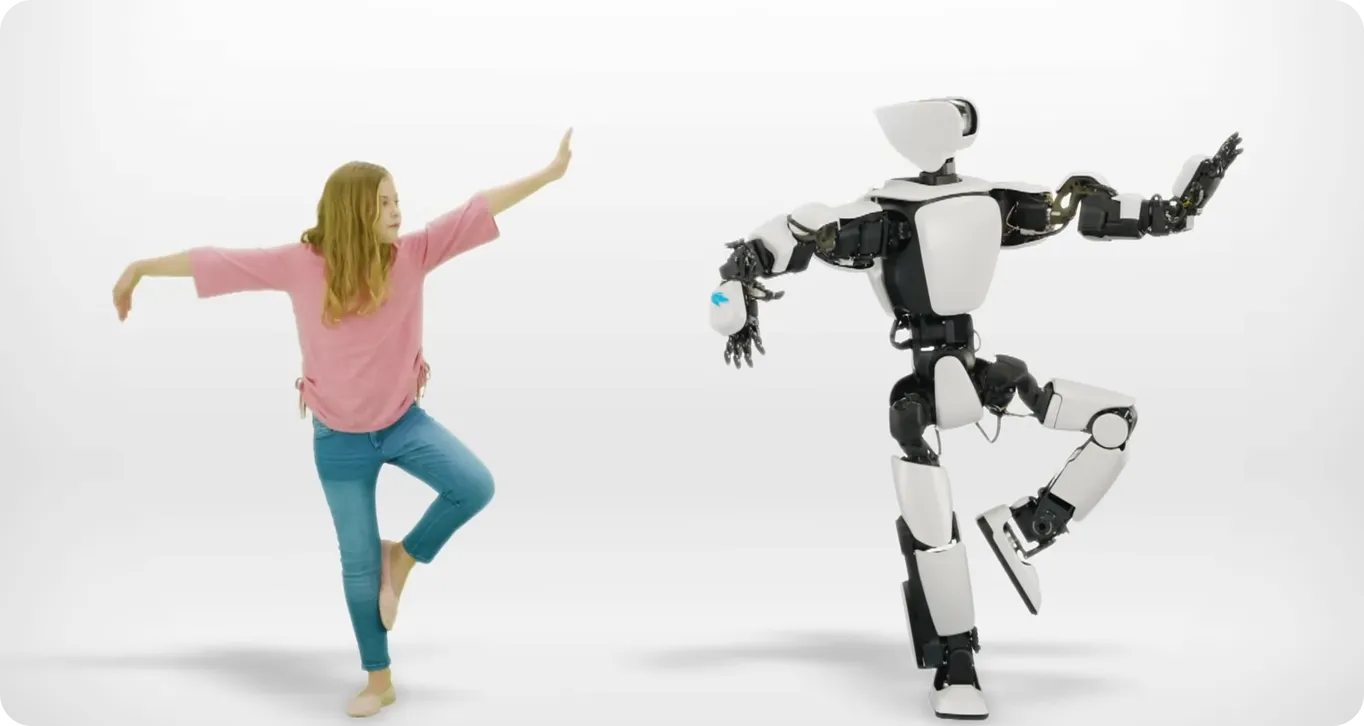

La vision par ordinateur est largement utilisée dans les robots humanoïdes, leur permettant d'apprendre en observant leur environnement. Des modèles comme YOLO11 peuvent contribuer à améliorer ce processus en fournissant une détection avancée des objets et une estimation de la pose, ce qui aide les robots à interpréter avec précision les actions et les comportements humains.

En analysant les mouvements et les interactions subtiles en temps réel, les robots peuvent être entraînés à reproduire des tâches humaines complexes. Cela leur permet d'aller au-delà des routines préprogrammées et d'apprendre des tâches, comme l'utilisation d'une télécommande ou d'un tournevis, simplement en regardant une personne.

Ce type d'apprentissage peut être utile dans différents secteurs. Par exemple, dans l'agriculture, les robots peuvent observer des travailleurs humains apprendre des tâches telles que la plantation, la récolte et la gestion des cultures. En copiant la façon dont les humains effectuent ces tâches, les robots peuvent s'adapter à différentes conditions agricoles sans avoir besoin d'être programmés pour chaque situation.

De même, dans le domaine des soins de santé, la vision par ordinateur devient de plus en plus importante. Par exemple, YOLO11 peut être utilisé dans des dispositifs médicaux pour aider les chirurgiens à réaliser des procédures complexes. Grâce à des fonctions telles que la détection d'objets et la segmentation d'instances, YOLO11 peut aider les robots à repérer les structures internes du corps, à gérer les outils chirurgicaux et à effectuer des mouvements précis.

Bien que cela puisse sembler sortir de la science-fiction, des recherches récentes démontrent l'application pratique de la vision par ordinateur dans les procédures chirurgicales. Dans une étude intéressante sur la dissection robotique autonome pour la cholécystectomie (ablation de la vésicule biliaire), les chercheurs ont intégré YOLO11 pour la segmentation des tissus (classification et séparation des différents tissus dans une image) et la détection des points clés des instruments chirurgicaux (identification de points de repère spécifiques sur les outils).

Le système était capable de distinguer avec précision les différents types de tissus, même lorsque les tissus se déformaient (changeaient de forme) pendant la procédure, et s'adaptait dynamiquement à ces changements. Cela a permis aux instruments robotiques de suivre des trajectoires de dissection (coupe chirurgicale) précises.

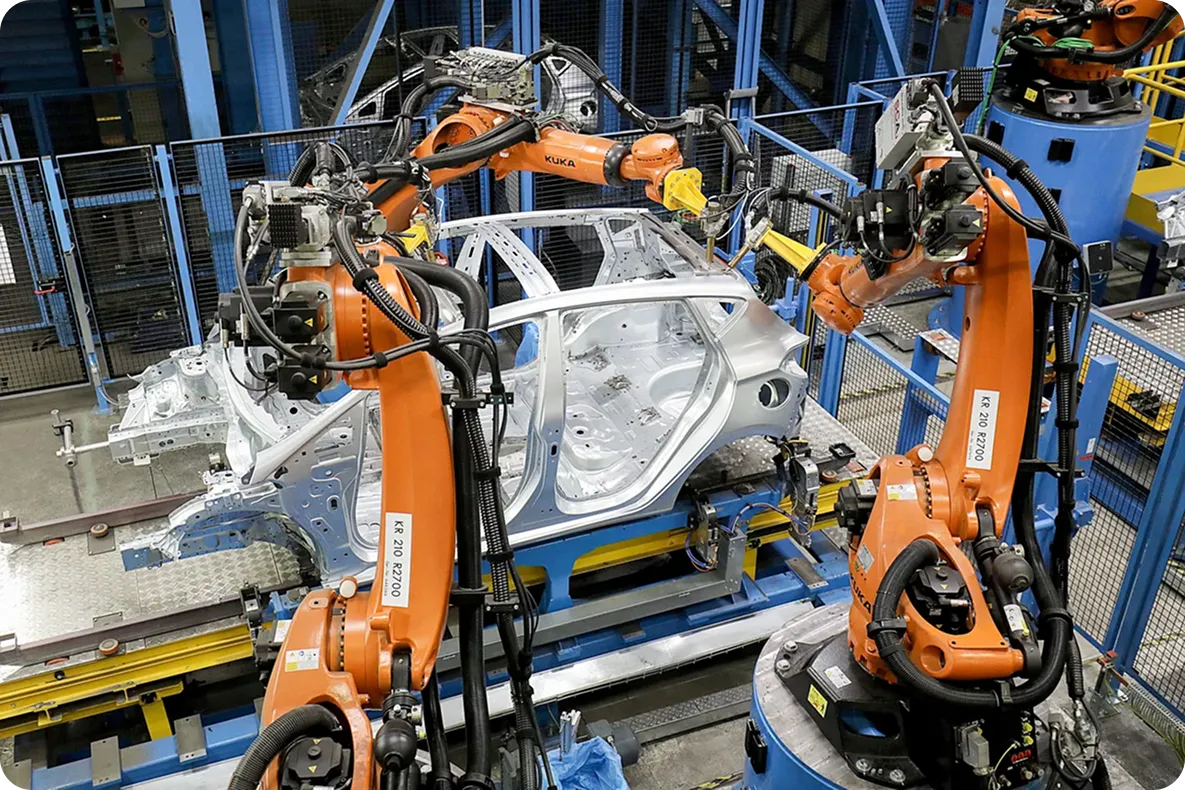

Les robots capables de ramasser et de placer des objets jouent un rôle clé dans l'automatisation des opérations de fabrication et l'optimisation des chaînes d'approvisionnement. Leur vitesse et leur précision leur permettent d'effectuer des tâches avec un minimum d'intervention humaine, comme l'identification et le tri des articles.

Grâce à la segmentation précise des instances de YOLO11, les bras robotiques peuvent être entraînés à detect et à segment objets se déplaçant sur un tapis roulant, à les ramasser avec précision et à les placer à des endroits déterminés en fonction de leur type et de leur taille.

Par exemple, les constructeurs automobiles les plus connus utilisent des robots basés sur la vision pour assembler différentes pièces de voitures, ce qui améliore la vitesse et la précision de la chaîne de montage. Les modèles de vision par ordinateur tels que YOLO11 peuvent permettre à ces robots de travailler aux côtés de travailleurs humains, assurant ainsi une intégration transparente des systèmes automatisés dans des environnements de production dynamiques. Cette avancée peut conduire à des temps de production plus rapides, à moins d'erreurs et à des produits de meilleure qualité.

YOLO11 offre plusieurs avantages clés qui le rendent idéal pour une intégration transparente dans les systèmes robotiques autonomes. Voici quelques-uns des principaux avantages :

Bien que les modèles de vision par ordinateur fournissent des outils puissants pour la vision robotique, il existe certaines limitations à prendre en compte lors de leur intégration dans des systèmes robotiques réels. Certaines de ces limitations incluent :

Les systèmes de vision artificielle ne sont pas seulement des outils pour les robots d'aujourd'hui ; ils sont les éléments constitutifs d'un avenir où les robots peuvent fonctionner de manière autonome. Grâce à leurs capacités de détection en temps réel et à leur prise en charge de multiples tâches, ils sont parfaits pour la robotique de nouvelle génération.

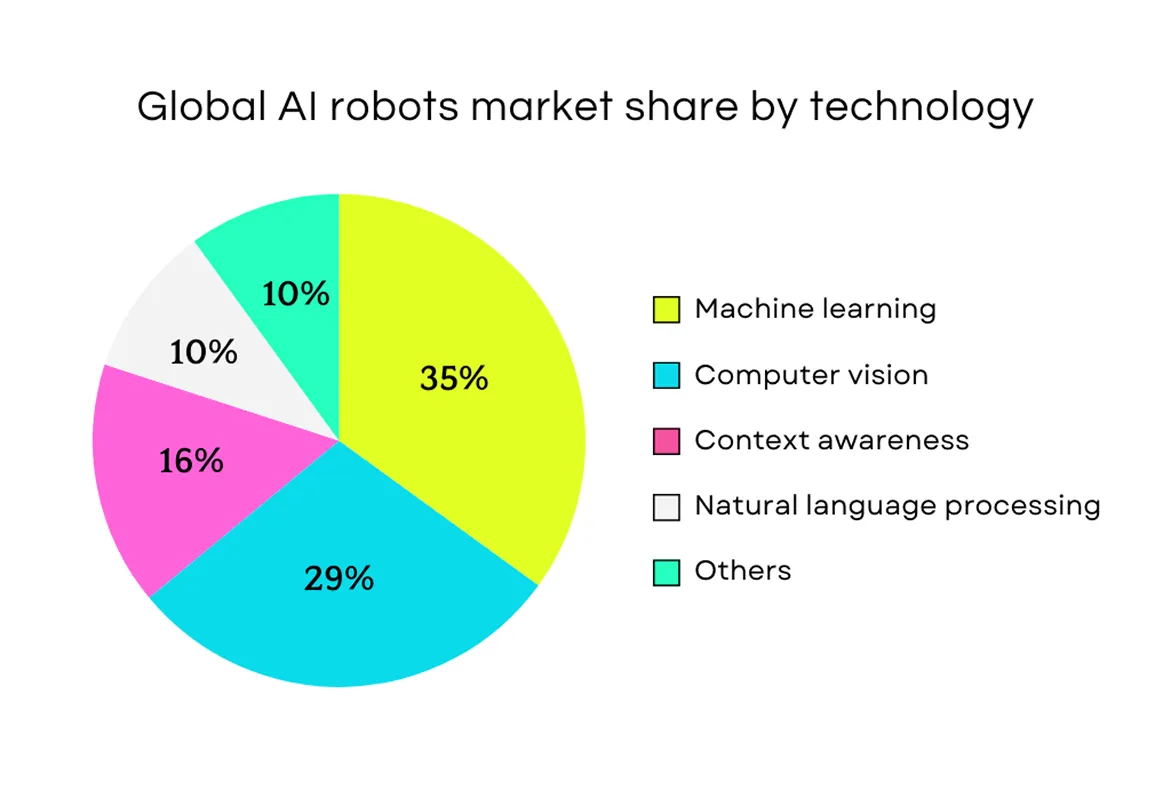

En fait, les tendances actuelles du marché montrent que la vision par ordinateur devient de plus en plus essentielle dans la robotique. Les rapports de l'industrie soulignent que la vision par ordinateur est la deuxième technologie la plus utilisée sur le marché mondial de la robotique basée sur l'IA.

Grâce à sa capacité à traiter des données visuelles en temps réel, YOLO11 peut aider les robots à detect, identifier et interagir avec leur environnement de manière plus précise. Cela fait une énorme différence dans des domaines tels que la fabrication, où les robots peuvent collaborer avec les humains, et les soins de santé, où ils peuvent participer à des opérations chirurgicales complexes.

À mesure que la robotique continue de progresser, l'intégration de la vision par ordinateur dans ces systèmes sera essentielle pour permettre aux robots de gérer plus efficacement un large éventail de tâches. L'avenir de la robotique s'annonce prometteur, avec l'IA et la vision par ordinateur qui stimulent des machines encore plus intelligentes et adaptables.

Rejoignez notre communauté et consultez notre dépôt GitHub pour en savoir plus sur les développements récents en matière d'IA. Explorez diverses applications de l'IA dans le secteur de la santé et de la vision par ordinateur dans l'agriculture sur nos pages de solutions. Consultez nos plans de licence pour créer vos propres solutions de vision par ordinateur.