Découvrez pourquoi il est essentiel d’aborder l’IA de manière éthique, comment les réglementations en matière d’IA sont gérées dans le monde entier et quel rôle vous pouvez jouer dans la promotion d’une utilisation éthique de l’IA.

Découvrez pourquoi il est essentiel d’aborder l’IA de manière éthique, comment les réglementations en matière d’IA sont gérées dans le monde entier et quel rôle vous pouvez jouer dans la promotion d’une utilisation éthique de l’IA.

La technologie de l'IA devenant de plus en plus populaire, les discussions sur l'utilisation éthique de l'intelligence artificielle (IA) sont devenues très courantes. Étant donné que beaucoup d'entre nous utilisent quotidiennement des outils alimentés par l'IA comme ChatGPT , il y a de bonnes raisons de se demander si nous adoptons l'IA d'une manière sûre et moralement correcte. Les données sont à la base de tous les systèmes d'IA, et de nombreuses applications d'IA utilisent des données personnelles telles que des images de votre visage, des transactions financières, des dossiers médicaux, des détails sur votre travail ou votre localisation. Où vont ces données et comment sont-elles traitées ? Telles sont quelques-unes des questions auxquelles l'IA éthique tente de répondre et de sensibiliser les utilisateurs de l'IA.

Lorsque nous discutons des questions éthiques liées à l'IA, il est facile de se laisser emporter et de tirer des conclusions en pensant à des scénarios comme Terminator et les robots qui prennent le contrôle. Cependant, la clé pour comprendre comment aborder l'IA éthique de manière pratique est simple et assez directe. Il s'agit de construire, de mettre en œuvre et d'utiliser l'IA d'une manière équitable, transparente et responsable. Dans cet article, nous allons explorer pourquoi l'IA doit rester éthique, comment créer des innovations éthiques en matière d'IA et ce que vous pouvez faire pour promouvoir l'utilisation éthique de l'IA. Commençons !

Avant de nous plonger dans les spécificités de l'IA éthique, examinons de plus près pourquoi elle est devenue un sujet de conversation si essentiel dans la communauté de l'IA et ce que signifie exactement pour l'IA d'être éthique.

L'éthique en matière d'IA n'est pas un nouveau sujet de conversation. Elle fait l'objet de débats depuis les années 1950. À l'époque, Alan Turing a introduit le concept d'intelligence artificielle et le test de Turing, une mesure de la capacité d'une machine à faire preuve d'une intelligence semblable à celle de l'homme par le biais de la conversation, ce qui a lancé les premières discussions éthiques sur l'IA. Depuis lors, des chercheurs ont commenté et souligné l'importance de prendre en compte les aspects éthiques de l'IA et de la technologie. Cependant, ce n'est que récemment que des organisations et des gouvernements ont commencé à créer des réglementations pour rendre l'IA éthique obligatoire.

Il y a trois raisons principales à cela :

Avec l'essor de l'IA et l'attention croissante qu'elle suscite à l'échelle mondiale, la conversation sur l'éthique de l'IA devient inévitable.

Pour vraiment comprendre ce que signifie l'éthique de l'IA, nous devons analyser les défis auxquels l'IA éthique est confrontée. Ces défis couvrent un éventail de questions, notamment les biais, la confidentialité, la responsabilité et la sécurité. Certaines de ces lacunes en matière d'IA éthique ont été découvertes au fil du temps en mettant en œuvre des solutions d'IA avec des pratiques injustes, tandis que d'autres peuvent apparaître à l'avenir.

.webp)

Voici quelques-uns des principaux défis éthiques de l'IA :

En relevant ces défis, nous pouvons développer des systèmes d'IA qui profitent à la société.

Ensuite, voyons comment mettre en œuvre des solutions d'IA éthiques qui traitent chacun des défis mentionnés ci-dessus. En se concentrant sur des domaines clés tels que la création de modèles d'IA non biaisés, la sensibilisation des parties prenantes, la priorité à la confidentialité et la garantie de la sécurité des données, les organisations peuvent créer des systèmes d'IA à la fois efficaces et éthiques.

La création de modèles d'IA non biaisés commence par l'utilisation d'ensembles de données diversifiés et représentatifs pour l'entraînement. Des audits réguliers et des méthodes de détection des biais aident à identifier et à atténuer les biais. Des techniques telles que le ré-échantillonnage ou la repondération peuvent rendre les données d'entraînement plus équitables. La collaboration avec des experts du domaine et l'implication d'équipes diversifiées dans le développement peuvent également aider à reconnaître et à traiter les biais sous différents angles. Ces étapes aident à empêcher les systèmes d'IA de favoriser injustement un groupe particulier.

.webp)

Plus vous en savez sur la boîte noire de l'IA, moins elle devient intimidante, ce qui rend essentiel pour toutes les personnes impliquées dans un projet d'IA de comprendre comment fonctionne l'IA derrière toute application. Les parties prenantes, y compris les développeurs, les utilisateurs et les décideurs, peuvent mieux aborder les implications éthiques de l'IA lorsqu'elles ont une compréhension globale des différents concepts de l'IA. Les programmes de formation et les ateliers sur des sujets tels que les biais, la transparence, la responsabilité et la confidentialité des données peuvent renforcer cette compréhension. Une documentation détaillée expliquant les systèmes d'IA et leurs processus de prise de décision peut aider à instaurer la confiance. Une communication régulière et des mises à jour sur les pratiques éthiques en matière d'IA peuvent également constituer un excellent ajout à la culture organisationnelle.

La priorité à la confidentialité implique l'élaboration de politiques et de pratiques solides pour protéger les données personnelles. Les systèmes d'IA doivent utiliser les données obtenues avec un consentement approprié et appliquer des techniques de minimisation des données afin de limiter la quantité d'informations personnelles traitées. Le chiffrement et l'anonymisation peuvent protéger davantage les données sensibles.

Le respect des réglementations sur la protection des données, telles que le RGPD (Règlement général sur la protection des données), est essentiel. Le RGPD établit des directives pour la collecte et le traitement des informations personnelles des individus au sein de l'Union européenne. La transparence concernant la collecte, l'utilisation et le stockage des données est également primordiale. Des évaluations régulières de l'impact sur la vie privée peuvent identifier les risques potentiels et aider à maintenir la confidentialité comme une priorité.

Outre la confidentialité, la sécurité des données est essentielle pour construire des systèmes d'IA éthiques. Des mesures de cybersécurité robustes protègent les données contre les violations et les accès non autorisés. Des audits de sécurité et des mises à jour réguliers sont nécessaires pour suivre l'évolution des menaces.

Les systèmes d'IA doivent intégrer des fonctions de sécurité telles que des contrôles d'accès, un stockage sécurisé des données et une surveillance en temps réel. Un plan clair de réponse aux incidents aide les organisations à résoudre rapidement tout problème de sécurité. En faisant preuve d'un engagement envers la sécurité des données, les organisations peuvent instaurer la confiance entre les utilisateurs et les parties prenantes.

Chez Ultralytics, l'IA éthique est un principe fondamental qui guide notre travail. Comme le dit Glenn Jocher, fondateur et PDG, "l'IA éthique n'est pas seulement une possibilité, c'est une nécessité" : "L'IA éthique n'est pas seulement une possibilité, c'est une nécessité. En comprenant et en respectant les réglementations, nous pouvons nous assurer que les technologies d'IA sont développées et utilisées de manière responsable dans le monde entier. L'essentiel est d'équilibrer l'innovation et l'intégrité, en veillant à ce que l'IA soit au service de l'humanité de manière positive et bénéfique. Montrons l'exemple et montrons que l'IA peut être une force pour le bien."

Cette philosophie nous pousse à donner la priorité à l'équité, à la transparence et à la responsabilité dans nos solutions d'IA. En intégrant ces considérations éthiques dans nos processus de développement, nous visons à créer des technologies qui repoussent les limites de l'innovation et respectent les normes de responsabilité les plus élevées. Notre engagement envers une IA éthique aide notre travail à avoir un impact positif sur la société et établit une référence pour les pratiques d'IA responsables dans le monde entier.

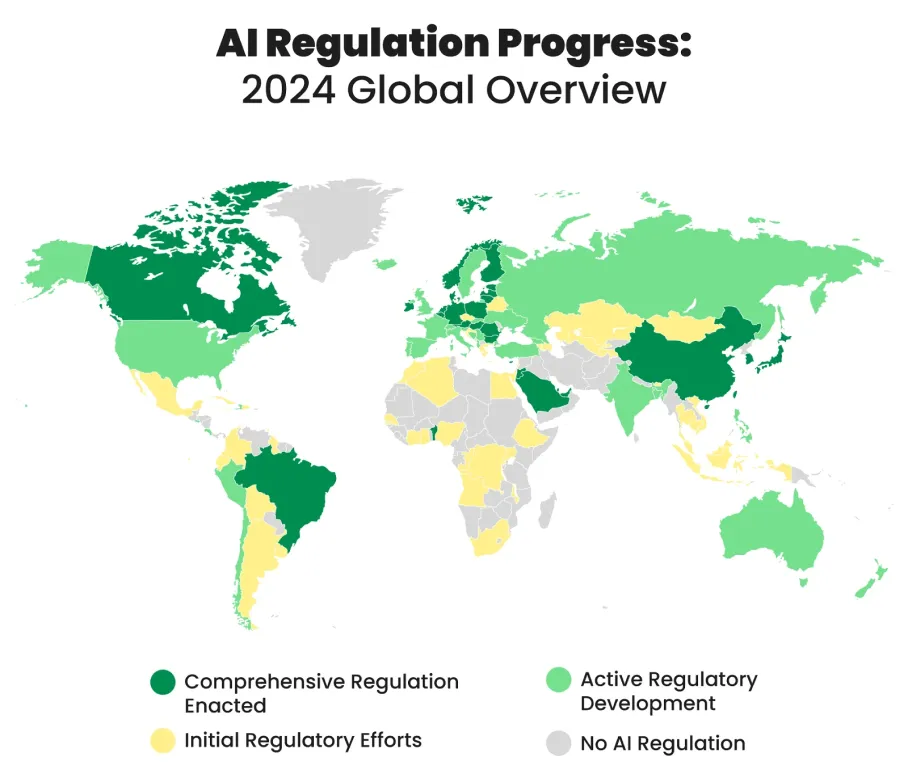

Plusieurs pays dans le monde développent et mettent en œuvre des réglementations en matière d'IA afin d'encadrer l'utilisation éthique et responsable des technologies d'IA. Ces réglementations visent à équilibrer l'innovation avec les considérations morales et à protéger les individus et la société contre les risques potentiels associés aux innovations en matière d'IA.

Voici quelques exemples de mesures prises dans le monde entier pour réglementer l'utilisation de l'IA :

Promouvoir une IA éthique est plus facile que vous ne le pensez. En vous renseignant sur des questions telles que la partialité, la transparence et la confidentialité, vous pouvez devenir une voix active dans la conversation autour de l'IA éthique. Soutenez et suivez les directives éthiques, vérifiez régulièrement l'équité et protégez la confidentialité des données. Lorsque vous utilisez des outils d'IA tels que ChatGPT, la transparence sur leur utilisation contribue à instaurer la confiance et à rendre l'IA plus éthique. En prenant ces mesures, vous pouvez contribuer à promouvoir une IA développée et utilisée de manière équitable, transparente et responsable.

Chez Ultralytics, nous nous engageons en faveur d'une IA éthique. Si vous souhaitez en savoir plus sur nos solutions d'IA et voir comment nous maintenons un état d'esprit éthique, consultez notre dépôt GitHub, rejoignez notre communauté et explorez nos dernières solutions dans des secteurs tels que la santé et la fabrication! 🚀