Einblicke in iOS 18: Ein Blick auf die Apple Funktionen für Barrierefreiheit

Apple hat neue KI-gestützte Funktionen zur Barrierefreiheit angekündigt, wie z. B. Eye Tracking, Music Haptics und Vocal Shortcuts, die nahtlose Benutzererlebnisse bieten.

Apple hat neue KI-gestützte Funktionen zur Barrierefreiheit angekündigt, wie z. B. Eye Tracking, Music Haptics und Vocal Shortcuts, die nahtlose Benutzererlebnisse bieten.

Am 15. Mai 2024 kündigte Apple eine Reihe von Updates für iOS 18 an, die einen starken Fokus auf Barrierefreiheit legen. Die neuen Apple-Updates, die noch in diesem Jahr veröffentlicht werden sollen, umfassen innovative Funktionen wie Eye Tracking, haptische Musik und Vocal Shortcuts.

Diese Apple-Funktionen für Barrierefreiheit erleichtern Menschen mit Mobilitätsproblemen, Gehörlosen oder Sehbehinderten sowie Menschen mit Sprachschwierigkeiten die Nutzung von Apple-Geräten. Apple Silicon, künstliche Intelligenz (KI) und maschinelles Lernen sind die technologischen Fortschritte, die hinter solchen Fähigkeiten stehen. Lassen Sie uns die neuen Funktionen von Apple und die Auswirkungen untersuchen, die sie auf das tägliche Leben haben werden.

Als Gesellschaft müssen wir sicherstellen, dass unsere technologischen Fortschritte alle Menschen einschließen. Der barrierefreie Zugang zu Technologie kann das Leben vieler Menschen verändern. So ist beispielsweise Technologie heutzutage ein wichtiger Bestandteil jedes Arbeitsplatzes, aber unzugängliche Schnittstellen können für Menschen mit Behinderungen Karrierehindernisse darstellen. Studien zeigen, dass die Arbeitslosenquote von Menschen mit Behinderungen im Jahr 2018 fast doppelt so hoch ist wie die von Menschen ohne Behinderungen.

Auch die Rechtssysteme befassen sich mit der Frage, wie Technologie zugänglich gemacht werden kann. Viele Länder haben Gesetze erlassen, die Barrierefreiheitsstandards für Websites und digitale Produkte vorschreiben. In den USA hat die Zahl der Klagen im Zusammenhang mit der Barrierefreiheit von Websites stetig zugenommen. Von 2017 bis 2022 wurden etwa 14.000 Klagen im Bereich der Web-Barrierefreiheit eingereicht, darunter über 3.000 allein im Jahr 2022. Unabhängig von den gesetzlichen Bestimmungen ist Barrierefreiheit für eine inklusive Gesellschaft, in der sich jeder voll und ganz beteiligen kann, von entscheidender Bedeutung. Hier kommen die folgenden Apple-Funktionen für Barrierefreiheit ins Spiel.

Apple arbeitet seit 2009 daran, Technologie für alle zugänglich zu machen. In diesem Jahr führten sie VoiceOver ein, eine Funktion, die es blinden und sehbehinderten Benutzern ermöglichte, mit Gesten und akustischem Feedback auf ihren iPhones zu navigieren. Das Vorlesen des Bildschirminhalts erleichtert den Benutzern die Interaktion mit ihren Geräten.

Seitdem hat Apple seine Bedienungshilfen kontinuierlich verbessert und erweitert. Sie führten Zoom für die Bildschirmvergrößerung, Invert Colors für einen besseren visuellen Kontrast und Mono Audio für Hörgeschädigte ein. Diese Funktionen haben die Interaktion von Benutzern mit verschiedenen Behinderungen mit ihren Geräten erheblich verbessert.

Hier ist eine genauere Betrachtung einiger der wichtigsten Apple-Funktionen für Barrierefreiheit, die wir in der Vergangenheit gesehen haben:

Eine Person mit eingeschränkter Handbeweglichkeit kann jetzt einfach im Internet surfen, Nachrichten versenden oder sogar Smart-Home-Geräte steuern, indem sie einfach auf ihren Bildschirm schaut. Diese Fortschritte erleichtern ihren Alltag und ermöglichen es ihnen, Aufgaben selbstständig zu erledigen, die sie zuvor als schwierig empfanden.

Eine weitere aufregende kommende Apple-Funktion für Barrierefreiheit ist Eye Tracking, die dies ermöglicht. Eye Tracking wurde für Benutzer mit körperlichen Einschränkungen entwickelt und bietet eine freihändige Navigationsoption auf iPads und iPhones. Durch den Einsatz von KI und der nach vorne gerichteten Kamera, um zu erkennen, wohin Sie schauen, können Sie mühelos Schaltflächen aktivieren, wischen und andere Gesten ausführen.

Die nach vorne gerichtete Kamera richtet das Eye Tracking in Sekundenschnelle ein und kalibriert es. Sie können Dwell Control verwenden, um mit App-Elementen zu interagieren und Funktionen wie Schaltflächen und Wischbewegungen nur mit Ihren Augen zu steuern. Die Nutzer können sich darauf verlassen, dass ihre Privatsphäre geschützt ist, da das Gerät alle Daten mit geräteinternem maschinellem Lernen sicher verarbeitet. Eye Tracking funktioniert nahtlos mit iPadOS und iOS Apps, ohne dass zusätzliche Hardware oder Zubehör benötigt wird. Apple Vision Pro's VisionOS beinhaltet ebenfalls eine Eye-Tracking-Funktion für eine einfache Navigation.

Music Haptics ist eine weitere der bald erscheinenden Apple-Funktionen für Barrierefreiheit. Es wurde für Benutzer entwickelt, die taub oder schwerhörig sind, um Musik auf ihren iPhones zu erleben. Bei der Verwendung erzeugt die Taptic Engine Taps, Texturen und raffinierte Vibrationen, die mit dem Audio synchronisiert sind. Sie können den Rhythmus und die Nuancen der Musik fühlen. Dies ist dank der Fähigkeit der Taptic Engine, verschiedene Intensitäten, Muster und Dauern von Vibrationen zu erzeugen, um das Gefühl der Musik einzufangen, sehr detailliert.

Music Haptics kann Menschen mit Hörproblemen auf eine Weise mit Musik verbinden, die bisher nicht möglich war. Dies eröffnet ihnen eine Welt neuer Erfahrungen im Alltag. Joggen mit Musik oder das Genießen eines Liedes mit einem Freund wird zu einem gemeinsamen und immersiven Erlebnis. Die Vibrationen können auf die Energie einer Workout-Playlist abgestimmt werden, was das Training motivierender macht, oder helfen, die Nerven mit einem Lieblingslied zur Meditation zu beruhigen. Music Haptics unterstützt Millionen von Songs im Apple Music-Katalog und wird als API für Entwickler verfügbar sein, sodass diese zugänglichere Apps erstellen können.

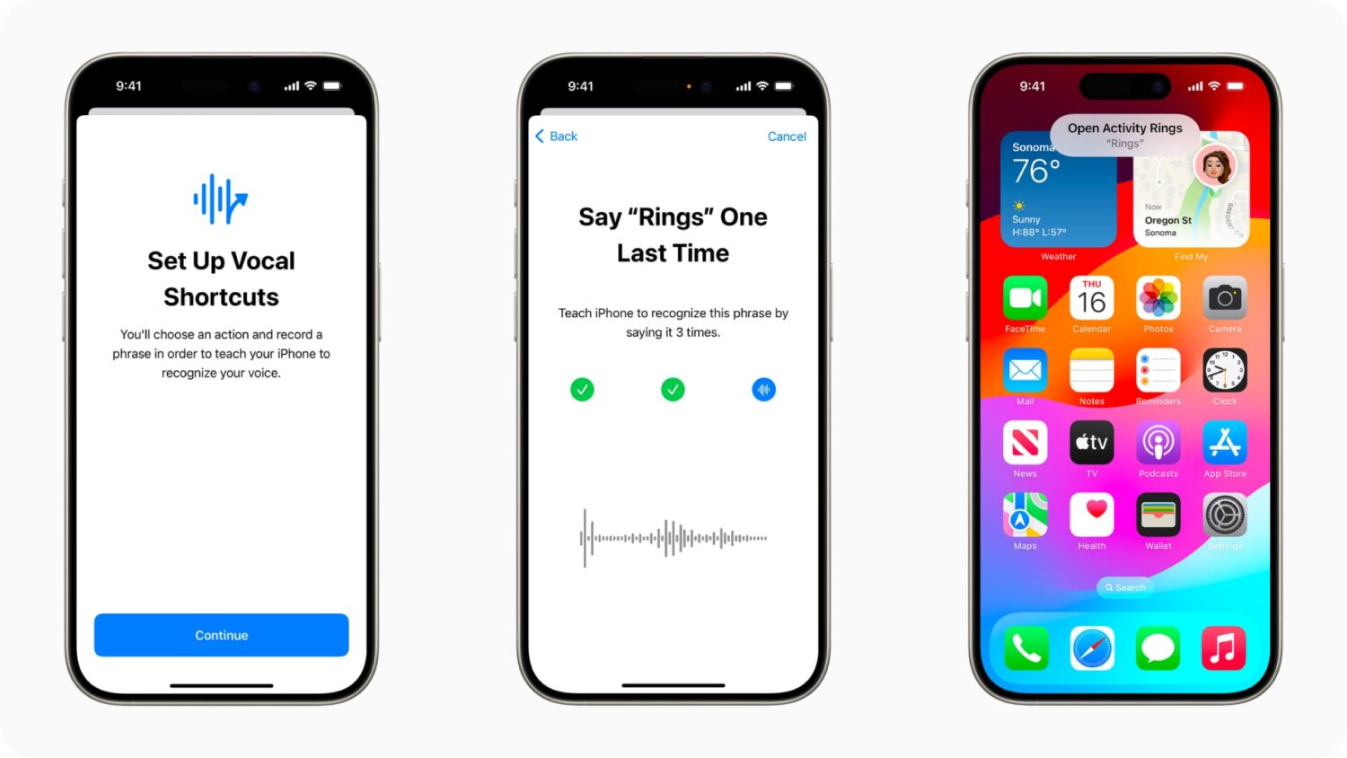

Apple hat Vocal Shortcuts entwickelt, um Sprachsysteme mithilfe von KI in der Liste der neuen Funktionen zur Barrierefreiheit zu verbessern. Es ermöglicht iPhone- und iPad-Nutzern, "benutzerdefinierte Äußerungen" zu erstellen, sodass Siri Verknüpfungen starten und komplexe Aufgaben verwalten kann. Dies ist besonders hilfreich für Menschen mit Erkrankungen wie Zerebralparese, ALS oder Schlaganfall.

Die Funktion "Auf atypische Sprache hören" nutzt On-Device Machine Learning, um verschiedene Sprachmuster zu erkennen und sich an sie anzupassen, wodurch Aufgaben wie das Senden von Nachrichten oder das Einstellen von Erinnerungen erleichtert werden. Durch die Unterstützung von benutzerdefinierten Vokabularen und komplexen Wörtern bieten Vocal Shortcuts eine personalisierte und effiziente Benutzererfahrung.

Es gibt auch ein paar neue Apple-Funktionen für die Barrierefreiheit, die Fahrgästen helfen sollen, ihre Geräte während der Reise komfortabler zu nutzen. Beispielsweise ist Vehicle Motion Cues eine neue Funktion für iPhone und iPad, die die Reisekrankheit von Fahrgästen in fahrenden Fahrzeugen reduzieren soll.

Die Bewegungskrankheit entsteht oft durch eine sensorische Diskrepanz zwischen dem, was eine Person sieht und dem, was sie fühlt. Vehicle Motion Cues löst dieses Problem, indem animierte Punkte an den Rändern des Bildschirms angezeigt werden, die Veränderungen in der Fahrzeugbewegung darstellen. So werden sensorische Konflikte reduziert, ohne den Hauptinhalt zu unterbrechen. Diese Funktion nutzt die in iPhones und iPads eingebauten Sensoren, um detect wenn sich der Benutzer in einem fahrenden Fahrzeug befindet, und passt sich entsprechend an.

CarPlay hat ebenfalls Updates erhalten, um die Barrierefreiheit zu verbessern. Die Sprachsteuerung ermöglicht es Benutzern, CarPlay und seine Apps mithilfe von Sprachbefehlen zu bedienen, während die Geräuscherkennung gehörlose oder schwerhörige Personen auf Autohupen und Sirenen aufmerksam macht. Für farbenblinde Benutzer verbessern Farbfilter die visuelle Benutzerfreundlichkeit der CarPlay-Oberfläche. Diese Verbesserungen tragen dazu bei, dass sich alle Fahrgäste während einer Autofahrt wohler fühlen.

Apple Vision Pro bietet bereits Apple Zugänglichkeitsfunktionen wie Untertitel, geschlossene Untertitel und Transkriptionen, die den Nutzern helfen, Audio und Video zu verfolgen. Jetzt baut Apple diese Funktionen weiter aus. Die neue KI-gesteuerte Funktion "Live Captions" ermöglicht es jedem, gesprochenen Dialogen in Live-Gesprächen und Audio aus Apps zu folgen, indem Text in Echtzeit auf dem Bildschirm angezeigt wird. Dies ist besonders für gehörlose oder schwerhörige Menschen von Vorteil.

Während eines FaceTime-Anrufs in VisionOS können die Benutzer beispielsweise den gesprochenen Dialog auf dem Bildschirm transkribiert sehen, was die Verbindung und Zusammenarbeit mit ihrer Persona (einem computergenerierten virtuellen Avatar) erleichtert.

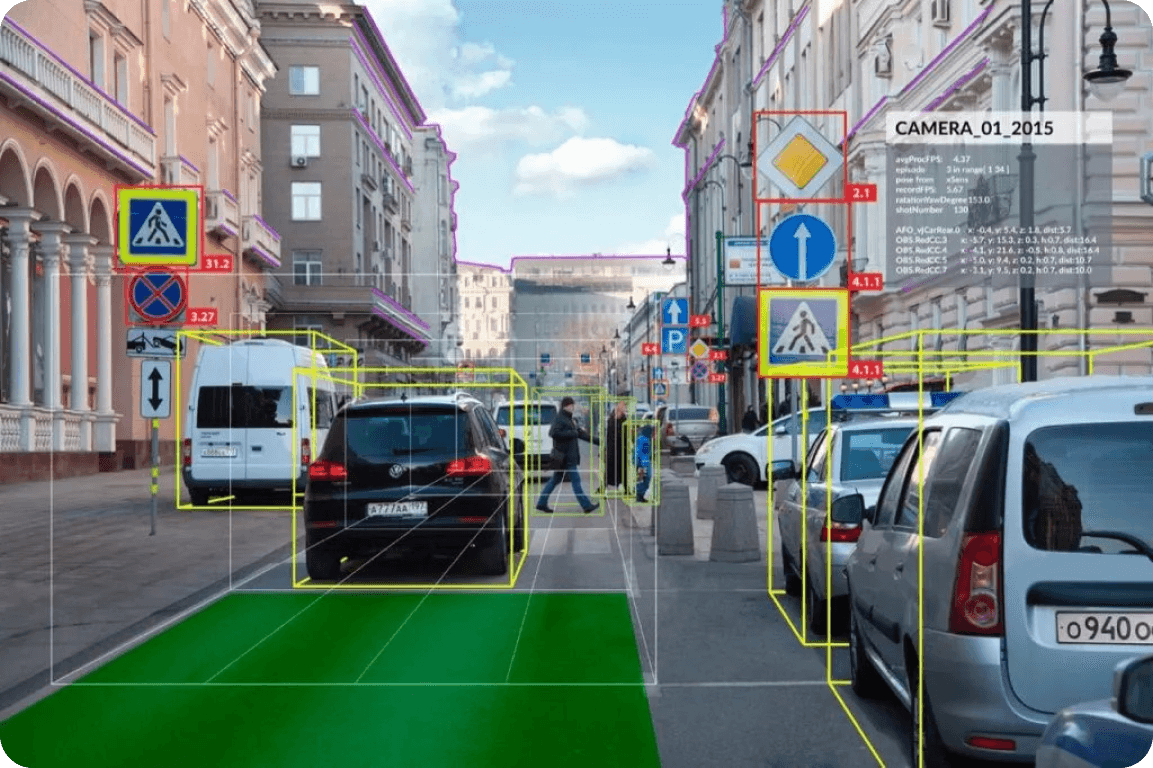

Ähnlich wie bei Apples Initiativen zur Barrierefreiheit forschen und entwickeln auch viele andere Unternehmen aktiv mit KI, um barrierefreie Lösungen zu schaffen. Zum Beispiel können KI-gestützte autonome Fahrzeuge Menschen mit Mobilitätsproblemen mehr Unabhängigkeit ermöglichen, indem sie das Selbstfahren erleichtern. Bisher konnten Menschen mit Behinderungen mit speziell umgebauten Fahrzeugen fahren, die über Anpassungen wie Handbedienungen, Lenkhilfen und rollstuhlgerechte Funktionen verfügen. Mit der Integration von KI-Technologien wie Computer Vision können diese Fahrzeuge nun noch mehr Unterstützung bieten.

Der Autopilot von Tesla ist ein gutes Beispiel für eine KI-gestützte Fahrhilfe. Er nutzt fortschrittliche Sensoren und Kameras, um Hindernisse detect , Verkehrssignale zu interpretieren und Navigationshilfe in Echtzeit zu leisten. Mit diesen KI-Eingaben kann das Fahrzeug verschiedene Fahraufgaben bewältigen, z. B. das Einhalten der Fahrspur und die Anpassung der Geschwindigkeit an die Verkehrsbedingungen. Die Erkenntnisse der Computer Vision machen das Fahren sicherer und zugänglicher für alle.

Mit diesen neuen Apple-Updates läuten wir eine neue Ära der KI-gesteuerten Inklusion ein. Durch die Integration von KI in seine Barrierefreiheitsfunktionen erleichtert Apple Menschen mit Behinderungen alltägliche Aufgaben und fördert Inklusion und Innovation in der Technologie. Diese Fortschritte werden sich auf verschiedene Märkte auswirken: Technologieunternehmen werden neue Maßstäbe für Inklusion setzen, das Gesundheitswesen wird von der größeren Unabhängigkeit von Menschen mit Behinderungen profitieren, und die Unterhaltungselektronik wird eine höhere Nachfrage nach barrierefreien Geräten verzeichnen. Es ist wahrscheinlich, dass die Zukunft der Technologie die Schaffung einer nahtlosen Benutzererfahrung für alle beinhaltet.

Besuchen Sie unser GitHub-Repository und werden Sie Teil unserer Community, um über die neuesten KI-Entwicklungen auf dem Laufenden zu bleiben. Entdecken Sie, wie KI die Technologie für selbstfahrende Autos, die Fertigung, das Gesundheitswesen und mehr verändert.