生成AIが進化するにつれて、AIによって生成された画像を識別する方法を学ぶことが重要です。偽物を効率的かつ効果的に見抜くためのヒント、ツール、テクニックをご紹介します。

生成AIが進化するにつれて、AIによって生成された画像を識別する方法を学ぶことが重要です。偽物を効率的かつ効果的に見抜くためのヒント、ツール、テクニックをご紹介します。

画像生成モデルは高度化しており、実物そっくりの人工知能(AI)画像が増加しています。AI画像と本物の写真の区別が難しくなるにつれて、AIと本物の写真の議論がより重要になっています。AIによって生成された画像がインターネットを欺いた事例が多数あります。私たちは、パファージャケットを着たローマ教皇フランシスコや、2024年のメットガラに登場したケイティ・ペリーを目にしました。どちらも生成AIによって作成された画像でした。言い換えれば、それらは本物ではありませんでした。しかし、一見したところ、インターネットはそれらを本物だと信じていました。

このような混同は時に面白いこともありますが、多くの場合、深刻な倫理的懸念を引き起こします。生成AIの仕組みを理解することが重要なように、何かがAIによって生成されたものかどうかを見分ける方法を知ることも重要です。この記事では、AIによって生成された画像を詳しく見て、AIアートの長所と短所を理解し、法的問題について議論し、それらを本物の画像と区別するための主要な方法とツールを探ります。

AI画像は、大規模なデータセットでトレーニングされたニューラルネットワークを使用して、リアルな画像を生成する画像生成モデルを使用して作成されます。印象的なのは、スタイル、コンセプト、機能を組み合わせて、芸術的で関連性の高い画像を作成する能力です。トレーニング中、画像生成モデルはこれらの画像からさまざまな特徴や詳細を学習します。そうすることで、学習した画像とスタイルやコンテンツが類似した新しい画像を作成するのに役立ちます。

画像生成モデルには多くの種類があり、それぞれに独自の特徴があります。たとえば、敵対的生成ネットワーク(GAN)は、トレーニングデータに似たリアルな画像を作成するために連携して動作する2つのニューラルネットワークを使用します。拡散モデルは、ランダムなノイズを徐々に鮮明な画像に変えることによって画像を生成します。DALL-EやCLIPなどのモデルで使用されているTransformerは、自己注意メカニズムを使用して、テキストによる説明から画像を生成します。

OpenAIのGPT-4o、Midjourney、Gencraft、Stable Diffusionなどのツールを使用すると、誰でもAI画像を作成できます。これらの画像は現在、インターネット上に広く公開されており、AIによって作成されたことを示すラベルがないことがよくあります。

写真や絵画のように、AI画像生成は多くの人に新しい芸術形式と見なされています。AI絵画は数千ドルで販売され、アートコンペで受賞しています。これは、AIアートは良いものなのか、そのような画像生成の長所と短所は何なのかという疑問を提起します。

これについてはさまざまな意見がある。例えば、予算が限られている中小企業は、生成されたアートをプラスと考えるかもしれない。ブランディングやマーケティングのニーズに完璧にマッチしたカスタムイメージを作成できるからだ。これらのツールは、高品質のビジュアルを素早く作成することで時間を節約し、クリエイティブなプロジェクトをtrack乗せるのに役立つ。アーティストのインスピレーションに関して、画像生成はユニークなオプションの膨大なライブラリへのアクセスを提供することができます。アーティストは、アイデアを形にする前に、簡単に視覚化することができます。

ただし、AIによって生成された画像は、感情的な深みに欠け、生身の人間の経験を捉えるのに苦労することがよくあります。品質が一貫せず、画像がピクセル化されたり、非現実的に見えることがあります。AIに頼りすぎると、創造性や批判的思考が阻害される可能性があります。また、誤用のリスクもあります。AI画像は簡単に操作でき、誤った情報につながる可能性があります。また、これらのツールを使用するには、急な学習曲線が必要になる場合があり、トレーニングデータからの偏りがある可能性があります。AIアートのその他の短所を次に示します。

AIの進歩に伴い、私たちは社会として、(著作権の問題のような)法的影響を積極的に解明している最中です。従来の創作物とは異なり、AIによって生成された画像は、本質的に既存の作品のリミックスであり、その多くはすでに著作権で保護されているため、米国などの一部の国では著作権で保護できません。AIトレーニングには、インターネットから収集された大量のデータが含まれることが多く、著作権で保護された素材が含まれる可能性があるため、事態は複雑になります。このため、多くの人々がAIモデルトレーニングに著作権で保護されたコンテンツを使用することに積極的に抗議しており、より良い規制を求めています。

訴訟を起こした企業もある。ストック画像を提供するゲッティイメージズは、ゲッティの画像ライブラリを複製し、商業的利益のために使用したとして、AIアートジェネレーターのStability AI 提訴 した。Stability AIテキストから画像への変換モデルによって生成された画像には、ゲッティの透かしが入っている。DeviantArtと他のAI企業2社も、AIが生成したアート作品が著作権法を侵害しているとして、あるアーティストから集団訴訟を起こされている。

AI画像がフェイクニュースで使用され、人々を欺くために利用されることが増えているため、特に選挙期間中は、AI画像を見分ける方法を学ぶことが不可欠です。BBCによると、研究者の60%がAIを使用して投票用紙や場所に関する誤解を招く画像を作成することに成功しました。

AI画像は消費者にも影響を与えます。Attestによる最近の調査では、ほとんどの消費者(76%)が本物の画像とAI生成画像の区別がつかないことが明らかになりました。画像がAIによって生成されたものかどうかを見分ける方法を以下に示します。

当然のことと思われるかもしれませんが、AI画像を見分ける最も簡単な方法は、説明とタグに「AI生成」と記載されているかどうかを確認することです。AI画像に関してはまだ多くの疑問が残されているため、AI画像を生成したり、ライセンス供与したりする企業は、その出所について透明性を確保するためにあらゆる努力をしています。AI画像をライブラリに含めるストックフォトエージェンシーは、画像タイトル、説明、および画像タグに「AI生成」というラベルを付けるようにコントリビューターに要求しています(これにより、カタログを閲覧する際にAI画像を検索または除外することが容易になります)。これらのラベルを探すことが、AI生成画像を見分ける最も簡単な方法です。

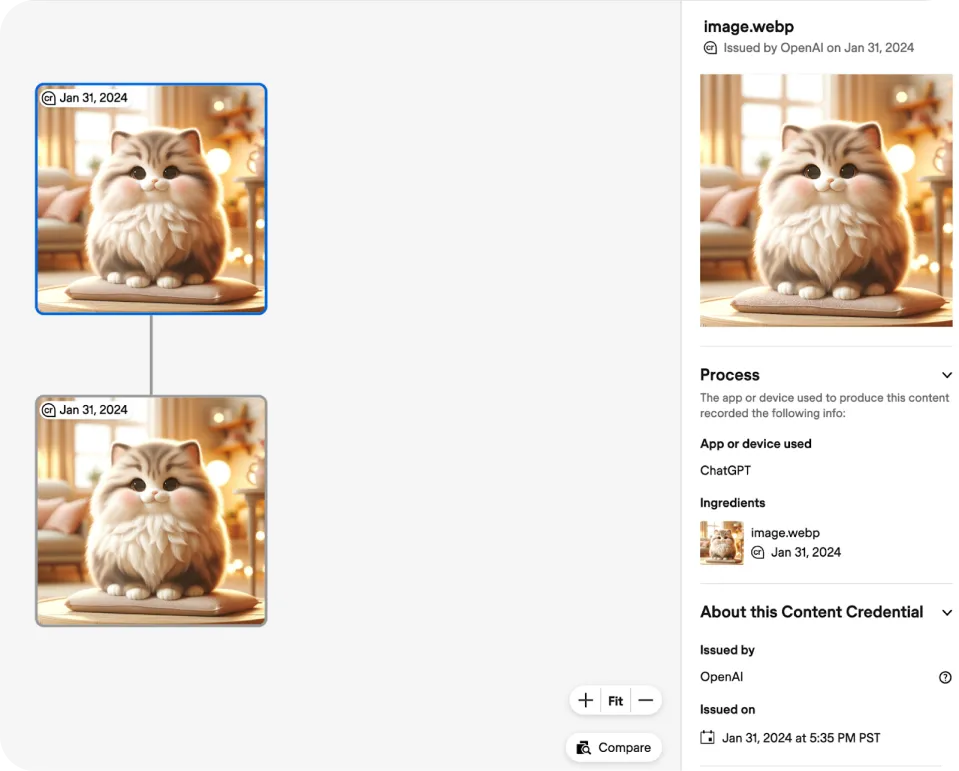

AI画像を識別するもう1つの方法は、多くのAIツールが追加している透かしを探すことです。これらには、小さなロゴ、テキスト、またはメタデータが含まれる場合があります。たとえば、OpenAIのDALL-E 3は、目に見えないC2PAメタデータと、左上隅に表示されるコンテンツ認証情報(CR)シンボルを使用しています。ただし、ロゴは、Content Credentials Verifyなどのコンテンツ認証情報検証サイトで画像を確認する場合にのみ表示されます。企業は画像を異なる方法でマークしている可能性があるため、さまざまな指標を理解する必要がある場合があります。

Google 最近、AI画像に電子透かしを入れる革新的な方法であるSynthIDを発表した。SynthIDは、AIが生成したコンテンツのピクセルに直接電子透かしを埋め込むことを可能にする。この電子透かしは人間の目には見えないが、識別のために検出することができる。SynthIDは、この電子透かしをスキャンすることで、AIツールが画像を作成した可能性が高いかどうかを評価することができる。

AIによって生成された画像には、深層学習アルゴリズムの制限により、不完全さがあることがよくあります。一般的な異常には、次のものがあります。

これらの兆候は、AIによって生成された画像を識別するのに役立ちます。ただし、AIの進歩により、将来のAI画像には目に見える欠陥が少なくなる可能性があります。

AI画像識別ツールを使用することも、AI画像を発見するための選択肢の1つですが、完全に正確であるとは限らないことに留意する必要があります。それでは、AI画像をdetect するための最も人気のあるツールをいくつか見てみましょう:

AIによって生成されたメディアが広がり、進化し続けるにつれて、これらのツールは将来さらに効果的になるでしょう。

生成AIモデルがより高度になるにつれて、AIが生成した画像と実際の写真を見分けることが難しくなっています。技術の進歩という点ではエキサイティングですが、倫理的な懸念もあります。AIがコスト効率が高く革新的なビジュアル作成方法を提供する一方で、考慮すべき法的および実際的なハードルが存在します。幸いなことに、この新たなジレンマを乗り越えるのに役立つ方法とツールが開発されています。常に最新の情報を得ることで、ビジュアルコンテンツの信頼性を確保できます。

AIについてさらに詳しく知るには、コミュニティにご参加ください!GitHubリポジトリをご覧になり、ヘルスケアや医療、農業など、さまざまな業界で革新的なソリューションを創出するために、私たちがどのようにAIを活用しているかをご確認ください。私たちと一緒に新たな可能性を切り開きましょう!